ChatGPT is een recent technologisch wonder dat wonderen verricht met eenvoudige tekst. Het heeft ons leven een stuk eenvoudiger gemaakt en maakte een einde aan het gezoek op internet naar relevante informatie.

Maar heb je je ooit afgevraagd of het beperkingen heeft? Elke technologie heeft beperkingen en dat geldt ook voor ChatGPT. In dit artikel gaan we meer leren over de beperkingen van ChatGPT om bewustzijn te creëren en je te helpen het efficiënter te gebruiken.

Overzicht van ChatGPT

ChatGPT is een taalmodel ontwikkeld door OpenAIgebaseerd op de GPT-architectuur (Generative Pre-trained Transformer). Het vertegenwoordigt de volgende generatie AI-taalmodellen en werd uitgebracht als onderdeel van de GPT-3.5-versie.

ChatGPT is ontworpen om mensachtige tekst te genereren en interactieve gesprekken te voeren met gebruikers. Het kan tekst in meerdere talen begrijpen en genereren en heeft een breed scala aan toepassingen, waaronder klantenservice, contentcreatie, taalvertalingen en nog veel meer.

Taalmodellen van ChatGPT

De GPT-modellen zijn gebouwd op de Transformer-architectuur, die in 2017 werd geïntroduceerd in het baanbrekende artikel "Attention is All You Need" van Vaswani et al. De Transformer-architectuur zorgde voor een revolutie in natuurlijke taalverwerkingstaken door gebruik te maken van zelf-attentiemechanismen, waardoor het model in staat was om lange-afstandsafhankelijkheden en contextuele relaties in tekst effectief vast te leggen.

Het primaire taalmodel dat gebruikt wordt in ChatGPT, GPT-3, bevat een duizelingwekkend aantal parameters (175 miljard vanaf GPT-3.5), waardoor het een van de krachtigste en meest data-intensieve taalmodellen ooit is. Deze enorme schaal draagt bij aan zijn vermogen om mensachtige tekst te genereren en een breed scala aan natuurlijke taalverwerkingstaken uit te voeren, waaronder het genereren van conversaties, taalvertaling, het beantwoorden van vragen en nog veel meer.

Beperkingen van ChatGPT

Het is belangrijk om op te merken dat ChatGPT weliswaar een krachtig taalmodel is, maar nog steeds beperkingen heeft. Het kan soms plausibel klinkende maar onjuiste of onzinnige antwoorden produceren.

Bovendien kan het, net als andere AI-modellen, vertekeningen vertonen in de gegevens waarop het getraind is. OpenAI blijft het systeem verbeteren en verfijnen op basis van feedback van gebruikers en gebruik in de echte wereld. Laten we de beperkingen in detail bekijken.

Gebrek aan gezond verstand

GPT-3 heeft geen begrip van de echte wereld en redeneert niet op basis van gezond verstand. Hoewel het samenhangende en contextueel passende tekst kan genereren, heeft het geen echt begrip van de wereld en kan het antwoorden produceren die feitelijk onjuist of onzinnig zijn.

Gevoeligheid voor inputzinnen

De antwoorden van het model kunnen erg gevoelig zijn voor de manier waarop een vraag of vraag wordt geformuleerd. Kleine veranderingen in de formulering kunnen leiden tot significant verschillende antwoorden, wat een uitdaging kan zijn voor gebruikers die consistente antwoorden zoeken.

Lange reacties en te veel zinnen

ChatGPT kan overdreven langdradig zijn en zichzelf herhalen, wat leidt tot langere reacties dan nodig. Het kan ook bepaalde zinnen te veel gebruiken of repetitief gedrag vertonen.

Gebrek aan bronvermelding

Het model kan de nauwkeurigheid van de informatie die het levert niet verifiëren en er is geen ingebouwd mechanisme om de bronnen van de informatie die het genereert te bevestigen. Dit betekent dat het plausibel klinkende maar misleidende of valse informatie kan produceren.

Vooroordelen

GPT-3 is getraind op een enorm corpus van internetteksten, die mogelijk vooroordelen bevatten in de gegevens. Als gevolg daarvan kan het model bevooroordeelde of vooringenomen reacties genereren op gevoelige onderwerpen of bevooroordeeld gedrag vertonen tijdens gesprekken.

Onvermogen om dubbelzinnigheden te verduidelijken

Wanneer het model wordt geconfronteerd met dubbelzinnige vragen of verzoeken om verduidelijking, raadt het vaak wat de gebruiker zou kunnen bedoelen, wat leidt tot mogelijke misverstanden.

Beperkt contextvenster

Hoewel ChatGPT context kan behouden tijdens een gesprek, is er nog steeds een grens aan de hoeveelheid context die het kan behouden. Langere gesprekken kunnen last hebben van contextfragmentatie, wat leidt tot minder coherente antwoorden.

Ongepaste reacties

Vanwege de trainingsgegevens kan ChatGPT soms reacties produceren die politiek vooringenomen, beledigend of ongepast zijn. OpenAI heeft veiligheidsbeperkingen geïmplementeerd, maar dergelijke reacties kunnen nog steeds af en toe voorkomen.

Hoge kosten

Toegang tot GPT-3 en andere soortgelijke taalmodellen via API's kan duur zijn, vooral voor uitgebreid gebruik of gebruik in grote volumes.

Gebrek aan real-time updates

Als voorgetraind model heeft GPT-3 geen toegang tot realtime informatie naast de trainingsgegevens. Dit betekent dat het mogelijk niet op de hoogte is van de laatste gebeurtenissen of ontwikkelingen. Hier is een voorbeeld:

Terwijl de huidige president Droupadi MurmuGPT 3.5 heeft er geen informatie over.

Gerelateerd artikel: ChatGPT Research Paper: Is het legitiem en ethisch?

Redenen voor onzinnige en foute antwoorden van ChatGPT

Onzinnige en foute antwoorden van ChatGPT, of om het even welk taalmodel, kunnen om verschillende redenen voorkomen. Hoewel taalmodellen zoals ChatGPT krachtig zijn en mensachtige tekst kunnen genereren, zijn ze niet perfect en hebben ze inherente beperkingen. Hier zijn enkele redenen voor onzinnige en foute antwoorden:

Gebrek aan begrip

Taalmodellen zoals ChatGPT missen echt begrip en gezond verstand. Ze genereren antwoorden op basis van patronen in de gegevens waarop ze getraind zijn, zonder de inhoud echt te begrijpen. Deze beperking kan leiden tot antwoorden die plausibel klinken maar geen werkelijke betekenis hebben.

Dubbelzinnigheid in Prompts

Als de gebruikersvraag of prompt dubbelzinnig is of niet voldoende context heeft, kan ChatGPT moeite hebben om passende antwoorden te genereren. Dubbelzinnigheid kan ertoe leiden dat het model onjuiste aannames doet of gissingen maakt.

Onvolledige of onvoldoende trainingsgegevens

Taalmodellen hebben grote en diverse trainingsdatasets nodig om effectief te generaliseren. Als de trainingsgegevens onvolledig zijn of bepaalde onderwerpen niet uitgebreid behandelen, reageert het model mogelijk niet accuraat op die onderwerpen.

Verschillende taken ondersteund door ChatGPT

ChatGPT is een veelzijdig taalmodel en ondersteunt een groot aantal taken in verschillende domeinen. De natuurlijke taalverwerkingsmogelijkheden stellen het in staat om verschillende taken uit te voeren, inclusief maar niet beperkt tot:

- Tekstgeneratie

- Vertaling

- Vraag beantwoorden

- Tekst samenvatten

- Taal begrijpen

- Hulp bij programmeren

- Creatieve schrijfopdrachten

- Wiskundige problemen oplossen

- Informatie zoeken

- Assisteren bij onderzoek

Dit zijn slechts enkele voorbeelden van de diverse taken die ChatGPT kan ondersteunen. De toepassingen worden voortdurend uitgebreid naarmate ontwikkelaars en gebruikers innovatieve manieren vinden om de taalverwerkingsmogelijkheden te gebruiken.

Lees ook: Onderzoek naar de rol van AI in academisch onderzoek

Inhoud creëren via conversatie met ChatGPT

Het maken van inhoud door middel van conversatie met ChatGPT is een meer interactieve benadering van het genereren van geschreven inhoud. In plaats van een enkele prompt te geven, gaan gebruikers een heen-en-weer gesprek aan met het taalmodel. Dankzij deze interactieve conversatie kunnen gebruikers hun inhoudsvereisten geleidelijk verfijnen en specificeren. Dit is hoe content maken met ChatGPT werkt:

Het gesprek aangaan

De gebruiker begint de conversatie door een initieel bericht te sturen naar ChatGPT. Dit bericht kan een algemeen onderwerp zijn of een specifiek verzoek voor het type inhoud dat ze willen maken.

De interactie voortzetten

ChatGPT reageert op het bericht van de gebruiker en genereert tekst op basis van de input. De gebruiker kan vervolgens feedback geven of om verduidelijking vragen om het proces van het genereren van inhoud te sturen.

De inhoud verfijnen

Door middel van een reeks uitwisselingen verfijnt de gebruiker zijn verzoek, geeft specifiekere instructies, vraagt om meer details of vraagt om wijzigingen in de gegenereerde tekst.

Iteratieve feedback

De feedback van de gebruiker is essentieel om ervoor te zorgen dat de gegenereerde inhoud overeenkomt met hun vereisten. Het gesprek gaat door tot de gebruiker tevreden is met de uiteindelijke inhoud.

De uiteindelijke inhoud genereren

Na een aantal interacties ontvangt de gebruiker de gewenste inhoud, die de vorm kan hebben van een artikel, blogbericht of een ander geschreven stuk op basis van de context van de conversatie.

ChatGPT heeft echt een revolutie teweeggebracht in het contentcreatieproces, maar als je het blindelings volgt, kun je in de problemen raken. Door dit AI-model te integreren, je intelligentie te gebruiken en de beperkingen van ChatGPT te begrijpen, kun je je reis naar het maken van inhoud tot een goed einde brengen.

De kern van de zaak

ChatGPT is een belangrijke stap voorwaarts in de verwerking van natuurlijke taal en heeft indrukwekkende mogelijkheden laten zien, maar het is niet zonder beperkingen. Als we kijken naar de toekomst van AI-taalmodellen, zal het aanpakken van deze beperkingen een belangrijke stap zijn in het bevorderen van het veld en het garanderen van een veilige en nuttige integratie van AI-technologie in ons leven.

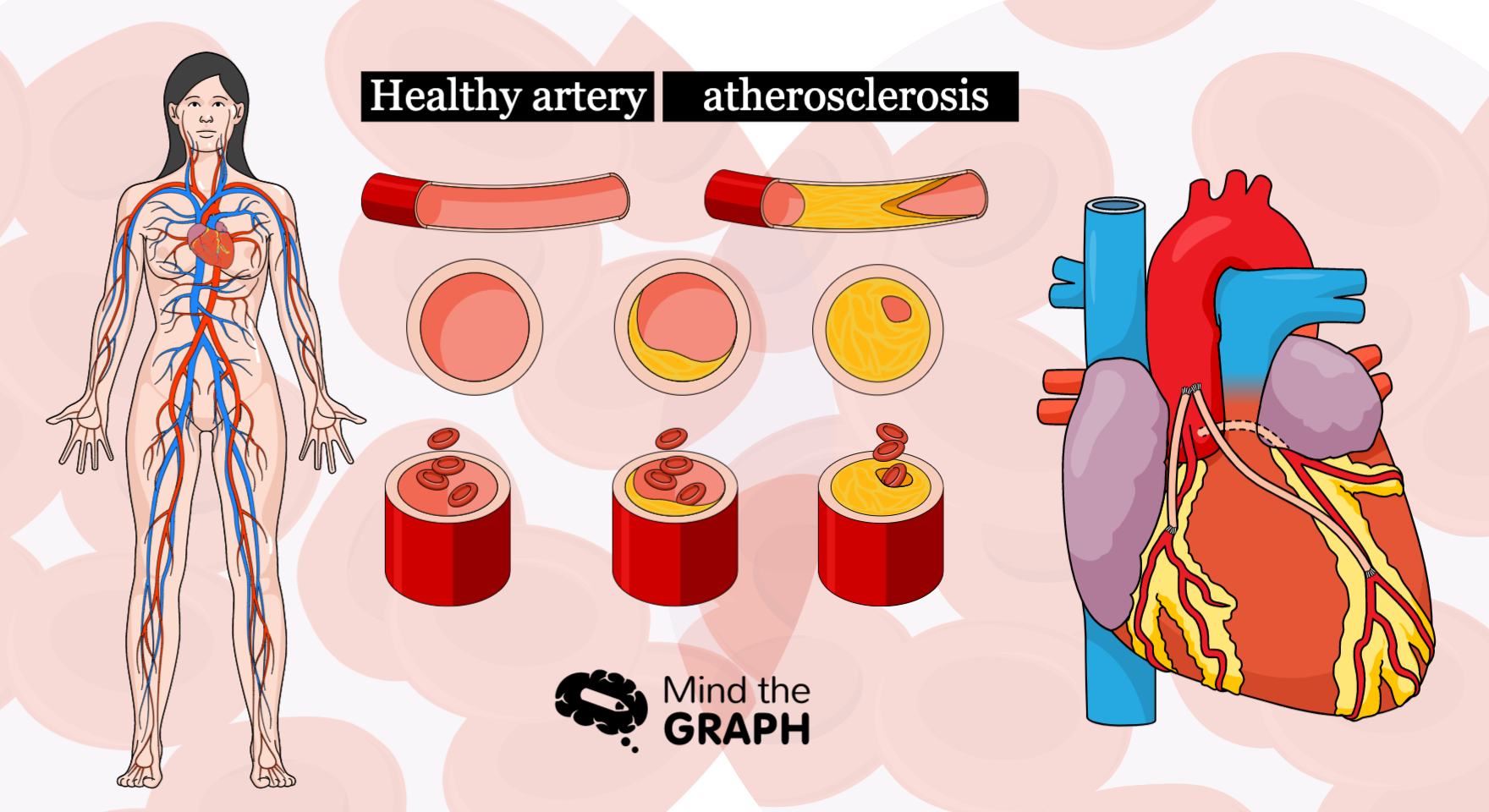

Online infographicmaker voor de wetenschap

Ben je op zoek naar een betrouwbare infografietool waarmee je gemakkelijk ontwerpen kunt maken? Nou, als onderzoeker weet je hoe belangrijk visuals en infographics zijn om je onderzoekspapers te verbeteren, dus hier is een hulpmiddel... Mind the Graph exclusief ontworpen voor het maken van kwaliteitsvolle infografieken over wetenschap. Meld je nu aan voor meer informatie.

Abonneer u op onze nieuwsbrief

Exclusieve inhoud van hoge kwaliteit over effectieve visuele

communicatie in de wetenschap.