ChatGPT 是一项最新的技术奇迹,它用简单的文字创造了奇迹。它为我们的生活带来了极大的便利,省去了在互联网上搜索相关信息的麻烦。

但您是否想过它是否有任何局限性?每种技术都有其局限性,ChatGPT 也是如此。在本文中,我们将了解 ChatGPT 的局限性,以提高大家的认识,帮助大家更有效地使用它。

聊天 GPT 概述

ChatGPT 是一种语言模型,由 OpenAI该模型基于 GPT(生成式预训练转换器)架构。它代表了新一代人工智能语言模型,作为 GPT-3.5 版本的一部分发布。

ChatGPT 可生成类人文本,并与用户进行交互式对话。它可以理解和生成多种语言的文本,应用范围广泛,包括客户支持、内容创建、语言翻译等。

聊天 GPT 的语言模型

GPT 模型基于 Transformer 架构构建,该架构在 Vaswani 等人于 2017 年发表的开创性论文 "Attention is All You Need "中介绍过。Transformer 架构利用自我注意机制彻底改变了自然语言处理任务,使模型能够有效捕捉文本中的长距离依赖关系和上下文关系。

ChatGPT 中使用的主要语言模型 GPT-3 包含数量惊人的参数(GPT-3.5 包含 1750 亿个参数),是迄今为止功能最强大、数据最密集的语言模型之一。如此庞大的规模使其有能力生成类人文本并执行广泛的自然语言处理任务,包括对话生成、语言翻译、问题解答等。

ChatGPT 限制

必须指出的是,虽然 ChatGPT 是一个强大的语言模型,但它仍有局限性。有时,它可能会生成听起来合理但不正确或无意义的回复。

此外,与其他人工智能模型一样,它可能会表现出训练数据中存在的偏差。OpenAI 将继续根据用户反馈和实际使用情况改进和完善系统。让我们详细了解其局限性。

缺乏常识

GPT-3 缺乏对现实世界的理解和常识推理。虽然它可以生成连贯且符合上下文的文本,但它对世界没有真正的理解,可能会产生与事实不符或无意义的回答。

对输入措辞的敏感性

模型的回答对问题或提示的措辞非常敏感。措辞上的细微变化都可能导致答案大相径庭,这对寻求一致答案的用户来说是个挑战。

冗长的回复和过度使用短语

ChatGPT 可能会过于啰嗦,可能会重复自己的内容,导致回复时间超过必要的长度。它还可能过度使用某些短语或表现出重复行为。

缺乏来源归属

模型无法验证其所提供信息的准确性,也没有内置机制来确认其生成信息的来源。这意味着它可能会生成听起来似乎合理但却具有误导性或虚假的信息。

偏见

GPT-3 是在庞大的互联网文本语料库中进行训练的,其中可能包含数据中存在的偏见。因此,该模型可能会对敏感话题产生带有偏见或成见的回答,或在对话中表现出带有偏见的行为。

无法澄清模糊之处

在面对模棱两可的询问或澄清请求时,模型往往会猜测用户的意图,从而导致潜在的误解。

有限语境窗口

虽然 ChatGPT 可以在对话过程中保持上下文,但它所能保留的上下文数量仍然有限。较长的对话可能会出现上下文支离破碎的情况,从而导致回复不够连贯。

不恰当的回应

由于其训练数据,ChatGPT 有时可能会生成带有政治偏见、攻击性或不恰当的回复。OpenAI 已经实施了安全缓解措施,但此类回复仍可能偶尔出现。

高成本

通过应用程序接口访问 GPT-3 和其他类似语言模型的成本可能会很高,尤其是在扩展或大量使用的情况下。

缺乏实时更新

作为一个预先训练好的模型,GPT-3 无法获取训练数据以外的实时信息。这意味着它可能无法了解最新的事件或发展。下面就是一个例子:

虽然现任总统 Droupadi Murmu而 GPT 3.5 没有相关信息。

来自 ChatGPT 的无意义和错误回复的原因

来自 ChatGPT 或任何语言模型的无意义和错误的回复可能是由多种原因造成的。虽然 ChatGPT 等语言模型功能强大,可以生成类似人类的文本,但它们并不完美,存在固有的局限性。以下是造成无意义和错误回复的一些原因:

缺乏理解

像 ChatGPT 这样的语言模型缺乏真正的理解和常识推理。它们会根据训练数据中的模式生成回复,而无法真正理解内容。这种局限性会导致回复听起来合理,但缺乏实际意义。

提示中的模糊性

如果用户的询问或提示含糊不清或缺乏足够的上下文,ChatGPT 可能难以生成适当的回复。模棱两可会导致模型做出错误的假设或猜测。

培训数据不完整或不充分

语言模型需要大量不同的训练数据集才能有效地泛化。如果训练数据不完整或没有全面覆盖某些主题,模型可能无法准确地响应这些主题。

ChatGPT 支持的各种任务

ChatGPT 是一种通用语言模型,可支持不同领域的各种任务。它的自然语言处理能力使其能够执行多项任务,包括但不限于

- 文本生成

- 语言翻译

- 问题解答

- 文本摘要

- 语言理解

- 编程帮助

- 创意写作提示

- 解决数学问题

- 信息检索

- 协助研究

这些只是 ChatGPT 可支持各种任务的几个例子。随着开发人员和用户找到利用其语言处理能力的创新方法,它的应用范围还在不断扩大。

另请阅读 探讨人工智能在学术研究中的作用

使用 ChatGPT 通过对话创建内容

使用 ChatGPT 通过对话创建内容涉及一种更具互动性的书面内容生成方法。用户与语言模型进行的不是单一的提示,而是来回的对话。通过这种互动对话,用户可以逐步完善和明确自己的内容要求。以下是使用 ChatGPT 创建内容的工作原理:

发起对话

用户通过向 ChatGPT 发送初始信息开始对话。这条信息可以是一般性的主题,也可以是对他们想要创建的内容类型的具体要求。

继续互动

ChatGPT 会回应用户的信息,并根据输入内容生成文本。然后,用户可以提供反馈或要求澄清,以指导内容生成过程。

完善内容

通过一系列的交流,用户会不断改进他们的请求,给出更具体的说明,要求提供更多细节,或要求修改生成的文本。

迭代反馈

用户的反馈对于确保生成的内容符合他们的要求至关重要。对话一直持续到用户对最终内容感到满意为止。

生成最终内容

经过几次互动后,用户会收到所需的内容,可以是文章、博文或任何其他基于对话背景的书面材料。

诚然,ChatGPT 彻底改变了内容创作流程,但如果盲目效仿,最终可能会陷入困境。整合这一人工智能模型,同时利用你的智慧并了解 ChatGPT 的局限性,可以帮助你在内容创作之旅中取得胜利。

底线

虽然 ChatGPT 代表了自然语言处理领域的重大进步,并展示了令人印象深刻的能力,但它并非没有局限性。展望人工智能语言模型的未来,解决这些局限性将是推动该领域发展的重要一步,并确保人工智能技术安全、有益地融入我们的生活。

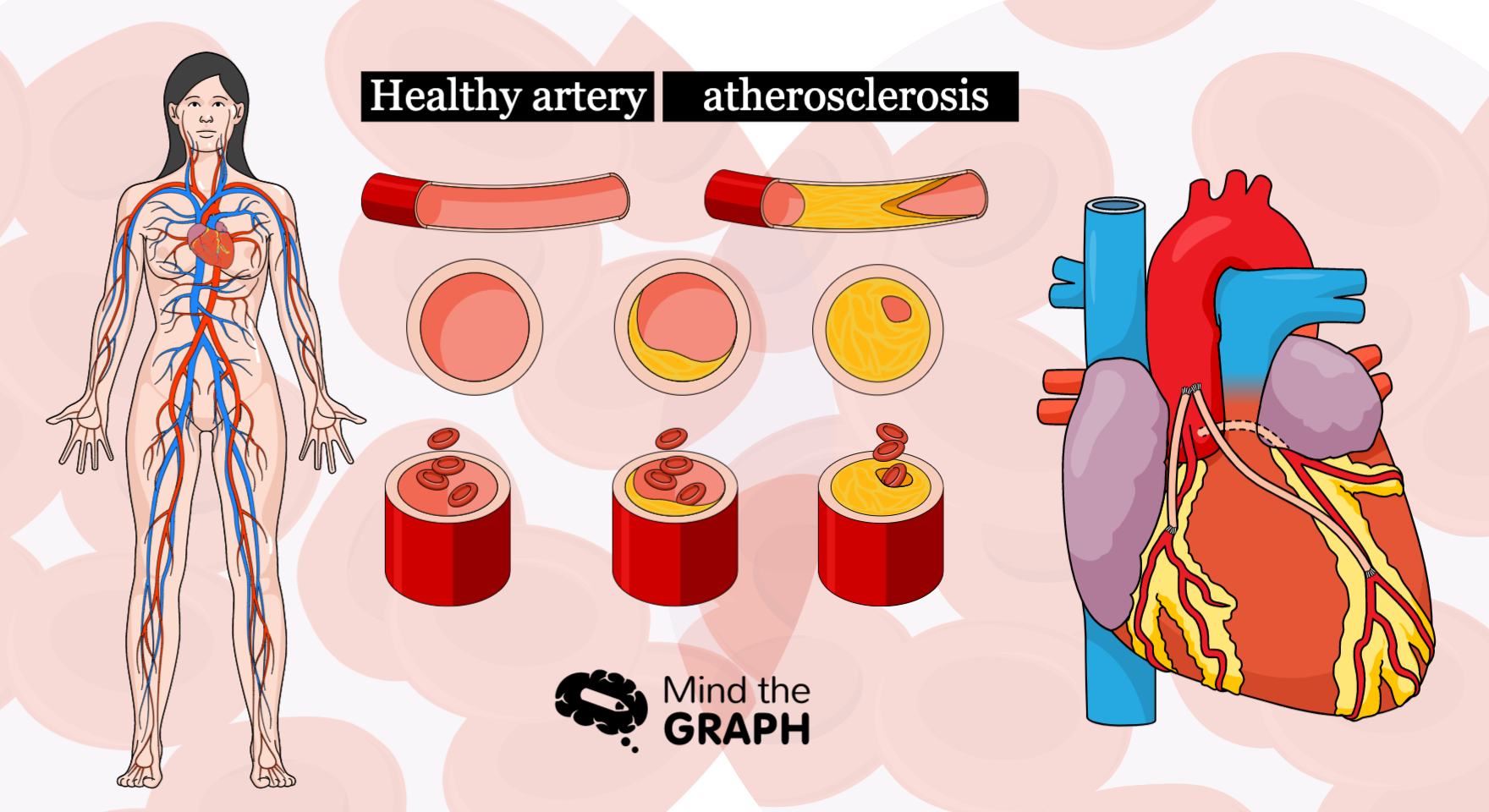

科学在线信息图表制作工具

您是否正在寻找一款可靠的信息图表工具,让您轻松完成设计?作为一名研究人员,您应该知道视觉效果和信息图表对研究论文的重要性。 Mind the Graph 专为制作与科学相关的高质量信息图表而设计。立即注册,了解更多信息。

订阅我们的通讯

关于有效视觉的独家高质量内容

科学中的交流。