days

hours

minutes

seconds

El blog científico Mind The Graph pretende ayudar a los científicos a aprender a comunicar la ciencia de forma sencilla.

Explore más a fondo la Tau de Kendall para comprender mejor las correlaciones de rango y cómo interpretar los datos ordenados.

El análisis de datos, que orienta las decisiones en una amplia variedad de ámbitos, es una parte crucial de la estadística. La estadística bayesiana tiene un marco intuitivo y flexible, que la distingue de otras metodologías estadísticas. He aquí una guía de la estadística bayesiana para principiantes, en la que se explican sus principios fundamentales, aplicaciones prácticas y ventajas inherentes. Este artículo introduce el concepto de inferencia bayesiana, que consiste en actualizar las creencias a partir de nuevas pruebas, para ayudar a los lectores a comprender su profunda influencia en la toma de decisiones. En este blog, desmitificaremos la estadística bayesiana para principiantes y, a continuación, mostraremos su relevancia y utilidad en diversos ejemplos del mundo real. A través de explicaciones claras y ejemplos ilustrativos, los lectores conocerán mejor los métodos bayesianos y su importancia en la práctica estadística contemporánea.

En el ámbito de la estadística, existe un poderoso marco que va más allá de los meros números y valores p. Con la estadística bayesiana, la probabilidad es algo más que una medida de frecuencia: es un reflejo de nuestras creencias e incertidumbres. La estadística bayesiana se basa en los principios de priores, verosimilitudes y distribuciones posteriores, que se analizarán en esta entrada del blog.

La estadística bayesiana utiliza un paradigma diferente para analizar los datos probabilísticos. La probabilidad se refiere a nuestra creencia de que es probable que ocurra un suceso, en lugar de a su frecuencia. Tres distribuciones componen el análisis bayesiano: a priori, probabilidad y a posteriori.

El teorema de Bayes es la piedra angular de la estadística bayesiana, que guía la actualización de nuestras creencias a partir de nuevas pruebas. Con el teorema de Bayes, las creencias previas se combinan con los datos observados para llegar a las probabilidades posteriores. Al formalizar la inferencia, afina nuestra comprensión del mundo. Esto puede expresarse matemáticamente del siguiente modo:

Ejemplo de teorema bayesiano de Wikipedia.

La inferencia bayesiana es un concepto fundamental de la estadística bayesiana, que se utiliza para hacer predicciones, extraer conclusiones y actualizar creencias basándose en pruebas. La inferencia bayesiana difiere de la frecuentista en que incorpora conocimientos previos a la distribución posterior, que representa creencias actualizadas, mediante la incorporación de datos observados.

Basándose tanto en el conocimiento previo como en los datos observados, la inferencia bayesiana estima la distribución de probabilidad de parámetros desconocidos. He aquí algunos ejemplos de inferencia bayesiana en acción:

En la estadística bayesiana, las distribuciones a priori y a posteriori desempeñan un papel fundamental a la hora de actualizar nuestras creencias sobre los parámetros de interés a la luz de los datos observados. Profundicemos en estos conceptos:

Las distribuciones previas describen lo que sabíamos sobre los parámetros antes de observar ningún dato. En ausencia de pruebas observacionales, sirven como representación matemática de la incertidumbre. Las inferencias basadas en distribuciones previas pueden tener un efecto significativo en los resultados.

A medida que estimamos los parámetros, utilizamos la distribución a priori para reflejar nuestra comprensión, experiencia o creencias subjetivas con respecto a estos parámetros. Como resultado, guía la inferencia posterior como mecanismo de regularización. Dependiendo de la fuerza de las creencias previas, los datos pueden tener diversos grados de influencia en la conclusión final.

Diferentes a priori pueden tener efectos profundos en las distribuciones posteriores. Consideremos un sencillo experimento de lanzamiento de una moneda como ejemplo de estimación de los porcentajes de acierto. Incluso con datos limitados que sugieran lo contrario, la distribución posterior puede seguir siendo cercana a 0,5 si tenemos fuertes creencias a priori de que la moneda es justa. A la inversa, una creencia previa escéptica que favorezca los valores extremos puede dar lugar a una distribución posterior que refleje ese escepticismo, a pesar de la abrumadora evidencia contraria.

Una distribución posterior representa nuestras creencias actualizadas sobre un parámetro tras incorporar los datos observados. Basándose en el teorema de Bayes, para calcularlas se combinan la verosimilitud de los datos dados los parámetros y su distribución a priori. Una distribución posterior se vuelve cada vez más dependiente de la función de verosimilitud a medida que se observan más datos, lo que cuantifica la fuerza con la que los diferentes valores de los parámetros están respaldados por los datos.

Por tanto, la distribución posterior refleja una síntesis de nuestras creencias previas y los datos observados. La distribución posterior puede utilizarse para hacer predicciones sobre acontecimientos futuros. También puede utilizarse para comparar distintas hipótesis y determinar su probabilidad de ser ciertas. La distribución posterior también puede utilizarse para tomar decisiones y evaluar las consecuencias de las distintas opciones. También puede utilizarse para asignar recursos y optimizar decisiones.

Siguiendo con el ejemplo del lanzamiento de la moneda, calculamos la distribución posterior del sesgo de la moneda basándonos en una serie de resultados del lanzamiento. En combinación con nuestras creencias previas y la información proporcionada por los datos observados, esta distribución posterior representa nuestra creencia actualizada sobre el sesgo de la moneda.

Basándose en pruebas observadas, los modelos bayesianos pueden utilizarse para analizar datos y hacer predicciones incorporando conocimientos previos. A lo largo de esta sección, examinaremos algunos aspectos clave de los modelos bayesianos, como la regresión lineal y los modelos jerárquicos. También analizaremos algunas aplicaciones de los modelos bayesianos, como la inferencia causal y el aprendizaje automático. Por último, analizaremos los puntos fuertes y débiles de los modelos bayesianos.

En estadística, la regresión lineal modela la relación entre una variable dependiente y una variable independiente. El marco bayesiano amplía la regresión lineal incorporando distribuciones a priori sobre los coeficientes de regresión y los errores. Esto permite una estimación más precisa de los parámetros de regresión y un mejor tratamiento de los valores atípicos. Además, los modelos de regresión lineal bayesiana pueden tratar datos que faltan y observaciones censuradas.

Los aspectos clave de la regresión lineal bayesiana incluyen:

La regresión lineal bayesiana ofrece varias ventajas, entre ellas:

El enfoque de modelización jerárquica es un enfoque bayesiano que permite modelizar estructuras de datos complejas que presentan múltiples niveles de variabilidad en términos de las variables subyacentes. En este método, los parámetros se organizan en una jerarquía, de forma que los parámetros de nivel superior capturan la variación a nivel de grupo, y los parámetros de nivel inferior capturan la variación a nivel individual. Esto permite a los investigadores estimar los efectos de los parámetros de nivel superior sin tener que examinar los efectos de los parámetros de nivel inferior. También permite a los investigadores identificar más fácilmente patrones en los datos que son difíciles de detectar con otros métodos.

Entre las ventajas del modelado jerárquico se incluyen:

El uso de modelos bayesianos, como la regresión lineal y la modelización jerárquica, permite a investigadores y profesionales profundizar en sus conocimientos y, al mismo tiempo, tener en cuenta la incertidumbre y los conocimientos previos.

Elegir el modelo bayesiano adecuado para un conjunto de datos o un problema es crucial cuando se utiliza la estadística bayesiana. Basadas en datos observados, las metodologías de comparación de modelos bayesianos proporcionan un marco riguroso para evaluar el rendimiento relativo de los modelos que compiten entre sí. En esta sección, exploramos algunos de los conceptos clave de la comparación de modelos bayesianos.

La comparación de modelos bayesianos implica la evaluación de las pruebas aportadas por los datos para cada modelo candidato. Al utilizar medidas probabilísticas, los métodos bayesianos cuantifican directamente el apoyo de los modelos que compiten entre sí, a diferencia de los enfoques frecuentistas, que suelen basarse en pruebas de hipótesis y valores p.

El concepto de factores de Bayes es el núcleo de la comparación bayesiana de modelos. Los factores de Bayes cuantifican la fuerza de las pruebas que apoyan un modelo frente a otro, teniendo en cuenta tanto el ajuste como la complejidad de los modelos. Representa el cociente de las probabilidades marginales de los dos modelos considerados. Las pruebas a favor del primer modelo se indican con un factor de Bayes superior a 1, mientras que las pruebas a favor del segundo modelo se indican con un factor de Bayes inferior a 1.

En el análisis bayesiano, los factores de Bayes proporcionan un enfoque basado en principios para la selección de modelos. Es posible identificar el mejor modelo comparando los factores de Bayes entre distintos modelos, lo que evita el sobreajuste y permite realizar inferencias sólidas.

La validación cruzada de los modelos bayesianos es otra herramienta eficaz para evaluar su rendimiento. Un proceso de validación cruzada consiste en dividir el conjunto de datos en conjuntos de entrenamiento y validación, ajustar el modelo a los datos de entrenamiento y, a continuación, evaluarlo con los datos de validación. Se utilizan varios subconjuntos de datos para el entrenamiento y la validación, lo que permite una estimación más precisa de la exactitud del modelo.

Para evaluar la precisión y la capacidad de generalización de los modelos pueden utilizarse diversas técnicas de validación cruzada, como la validación cruzada bayesiana, la validación cruzada LOO-CV y la validación cruzada K-fold. Estos métodos proporcionan información complementaria a los factores de Bayes, ya que evalúan la capacidad de los modelos para realizar predicciones sobre datos nuevos y desconocidos. Estas técnicas también proporcionan una estimación de la sensibilidad del modelo a los cambios en los datos, lo que puede ayudar a identificar posibles fuentes de sesgo.

Al equilibrar la complejidad del modelo y el rendimiento predictivo con factores bayesianos y métodos de validación cruzada, los investigadores pueden tomar decisiones informadas sobre la selección de modelos.

La estadística bayesiana es un marco potente y flexible para la inferencia y el modelado estadísticos, con ventajas que van desde la capacidad de incorporar información a priori hasta su robustez en el manejo de la incertidumbre. He aquí algunas ventajas:

La estadística bayesiana tiene muchas ventajas y limitaciones, pero puede ser útil a la hora de inferir y tomar decisiones. Para que los profesionales apliquen los métodos bayesianos con eficacia, deben comprender estos aspectos. Considere estos factores clave:

El enfoque bayesiano ofrece numerosas ventajas, pero su aplicación presenta numerosos retos y limitaciones. Los profesionales que comprenden estos aspectos y aplican las estrategias adecuadas pueden sacar el máximo partido de los métodos bayesianos en diversos ámbitos.

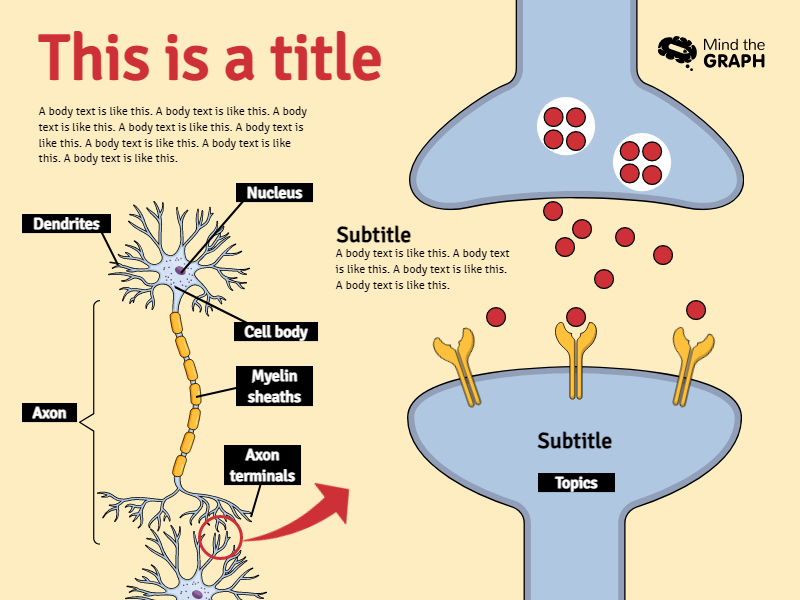

Con este cambio de juego en el mundo académico, la investigación y las disertaciones serán más sencillas. Podrá integrar fácilmente elementos visuales en sus borradores utilizando Mind the Graphmejorando la claridad y generando más citas. Al involucrar visualmente a su audiencia en su investigación, puede aumentar el impacto y la accesibilidad de su trabajo. Mind the Graph es una potente herramienta para crear infografías atractivas que puede utilizar para mejorar su comunicación científica. Visite nuestra sitio web para más información.

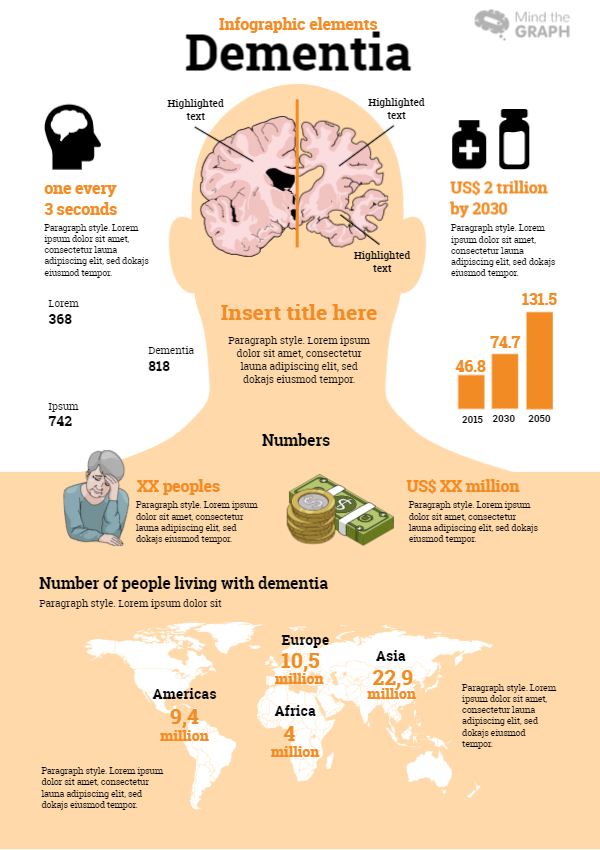

Evaluar la fiabilidad de las revistas académicas es una preocupación fundamental para los investigadores que navegan por el panorama cada vez más amplio de la publicación académica. La pregunta "¿Cree que esta revista es fiable o no?" resuena sin duda entre los investigadores de todas las disciplinas y a menudo suscita discusiones con colegas o mentores. En un entorno plagado de revistas engañosas, fraudulentas o pseudorrevistas -sinónimo de publicación depredadora-, navegar por el terreno de la ética de la publicación resulta cada vez más complejo. La proliferación de este tipo de revistas depredadoras supone una importante amenaza para la integridad del discurso académico, ya que socava la credibilidad de la investigación académica y erosiona la confianza en la difusión del conocimiento.

En el contexto de la generación exponencial de datos y la omnipresencia de la presión por publicar, nunca se insistirá lo suficiente en la necesidad de seleccionar revistas reputadas para la referenciación y la difusión. Los investigadores deben estar equipados con las herramientas y los conocimientos necesarios para discernir entre los medios académicos legítimos y las empresas depredadoras que se hacen pasar por plataformas creíbles para el discurso académico. La capacidad de identificar las revistas depredadoras no es una mera cuestión de prudencia académica, sino una habilidad esencial para salvaguardar la integridad y la credibilidad de las propias contribuciones de investigación.

Reconociendo la urgencia de este desafío en el panorama de la investigación contemporánea, se hace imperativo que los investigadores cultiven una comprensión de los indicadores y marcadores que distinguen a las auténticas revistas académicas de sus contrapartes depredadoras. Al adquirir destreza en el discernimiento de la autenticidad y la transparencia de las revistas, los investigadores pueden mitigar los riesgos asociados a la publicación depredadora y defender los principios de la integridad académica. Para ello es necesario un enfoque polifacético que abarque un examen exhaustivo de las diversas facetas de la credibilidad de las revistas, desde las prácticas editoriales y los procedimientos de revisión por pares hasta el estado de indexación y la ética de publicación.

Entre los indicadores clave de una revista reputada figuran un proceso transparente y riguroso de revisión por pares, políticas editoriales claramente articuladas y un distinguido consejo editorial compuesto por expertos en la materia. Las revistas legítimas suelen cumplir las directrices éticas establecidas, como las de organizaciones como la Comité de Ética de la Publicación (COPE), defendiendo así las normas de integridad y transparencia en la publicación académica. Además, las revistas depredadoras a menudo carecen de indexación en bases de datos acreditadas y pueden incurrir en prácticas poco éticas como el plagio, la falsificación de datos o la manipulación de las métricas de citación.

Artículo relacionado: Proceso de revisión por pares: El camino hacia la publicación

En conclusión, la capacidad de discernir entre las revistas académicas fiables y las entidades depredadoras es indispensable para los investigadores que tratan de mantener la integridad y la credibilidad de sus actividades académicas. Al dotarse de los conocimientos y herramientas necesarios para identificar las prácticas editoriales engañosas, los investigadores pueden navegar por el panorama académico con confianza, asegurándose de que sus contribuciones a la comunidad científica se difunden a través de canales fiables y reputados. Permítanos ayudarle a comprender mejor este asunto.

Jeffrey Beall, antiguo bibliotecario de la Universidad de Colorado, Denver, acuñó el término "revistas depredadoras". Solía mantener una lista de lo que consideraba editoriales y revistas depredadoras, que publicaba en su blog. Beall definía las revistas depredadoras como aquellas que explotan el modelo de publicación de acceso abierto con fines lucrativos sin ofrecer el nivel esperado de servicios editoriales o de publicación. Un sitio web llamado Lista de Beall sigue llevando una cuenta de las revistas depredadoras y las listas se actualizan de vez en cuando. No obstante, queda a discreción de cada cual buscar en las revistas y no fiarse enteramente de la lista.

Lea también: Pros y contras de la publicación en acceso abierto: dar poder a los académicos

Las revistas depredadoras suelen dar prioridad al lucro sobre la difusión de investigaciones creíbles y pueden dañar la integridad de las publicaciones académicas al permitir que entren en el registro académico investigaciones de calidad inferior o engañosas. Identificar y evitar las revistas depredadoras es importante para que los investigadores garanticen la calidad y fiabilidad de su trabajo.

Si miramos la historia, es difícil señalar un único incidente a partir del cual comenzó la evolución de las revistas depredadoras. Se debió más bien a la acumulación de más de un acontecimiento que señaló la importancia de la revisión por pares.

Sin embargo, un primer caso notable que se cita a menudo es la publicación de un artículo científico falso por el físico Alan Sokal en 1996. Sokal presentó un artículo disparatado titulado "Transgredir los límites: Hacia una hermenéutica transformadora de la gravedad cuántica" a la revista de estudios culturales "Social Text". El trabajo fue aceptado y publicado, a pesar de estar lleno de jerga y argumentos sin sentido. Aunque este incidente puso de manifiesto problemas en determinados segmentos de la publicación de estudios culturales y no la publicación depredadora en sí, sí planteó cuestiones sobre el rigor de la revisión por pares en determinadas disciplinas académicas.

Más tarde, con el auge de la necesidad de publicar en la revista como norma académica, a los editores les resultó fácil aprovechar la necesidad y las editoriales de revistas crecieron como setas en todo el mundo.

Pero, ¿cómo podemos saber si las revistas a las que enviamos nuestro trabajo son depredadoras o no? Para ayudarle en el proceso de identificación, a continuación se detallan las características de una revista depredadora identificadas por los investigadores Elmore y Weston en 2020. Leerlos con atención y recordar alguna de las experiencias que has tenido en tu carrera te ayudará a recordar mejor las características.

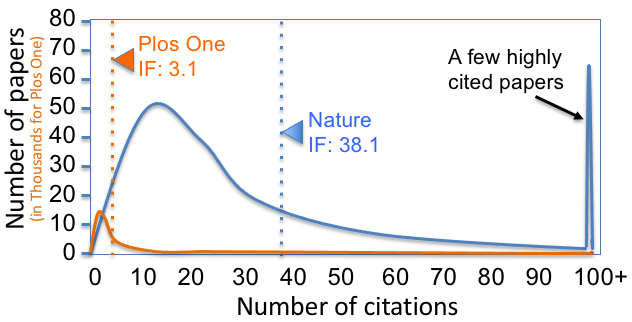

Las revistas depredadoras suelen anunciar en su sitio web un Factor de Impacto de la Revista u otra métrica de citas, que puede ser incorrecta o imposible de verificar. Estas revistas no suelen publicar ningún factor de impacto en la página de inicio del sitio web. Si aparecen cifras en la página de inicio, las palabras utilizadas no se pueden relacionar directamente con un factor de impacto. Si hay enlaces que explican el factor de impacto, vaya al enlace y lea los detalles. Consulte los factores de impacto de tres o cinco años y las citas de los trabajos de investigación publicados por la revista para conocer el factor de impacto real. Un investigador también puede encontrar orientación sobre los informes de citas de revistas en "Medir el impacto de su investigación: Journal Citation Reports (JCR)“.

Estas revistas pueden prometer un plazo de publicación poco realista, tentando a los autores con plazos de entrega rápidos que a menudo son inalcanzables. Una revista revisada por pares necesitará normalmente un plazo más largo para la publicación, ya que los revisores necesitarán al menos 1-3 meses para proporcionarle los comentarios de los revisores.

Las revistas depredadoras publican todos los artículos por los que los autores pagan un Article Processing Charge (APC), independientemente de la calidad, la relevancia para el ámbito de la revista o la coherencia del contenido.

Los artículos de las revistas depredadoras suelen contener numerosos errores gramaticales debido a la escasa o nula revisión editorial, lo que compromete la calidad de la investigación publicada.

Lea también: Corrección de textos frente a revisión: El arte de refinar el texto

Los consejos editoriales de las revistas depredadoras pueden incluir personas ficticias, personas que carecen de las credenciales pertinentes o personas que desconocen su asociación con la revista, lo que socava la credibilidad de la publicación.

Algunas revistas depredadoras imitan el nombre o el sitio web de revistas legítimas conocidas, engañando a los autores para que envíen sus trabajos a medios ilegítimos.

Las revistas depredadoras se dirigen agresivamente a los autores potenciales a través de correos electrónicos basura, a menudo inundando a los investigadores con solicitudes de envío.

Estas revistas pueden afirmar tener oficinas en un país mientras facilitan datos de contacto situados en otro, lo que se suma a la falta de transparencia de sus operaciones.

Los correos electrónicos de solicitud de revistas depredadoras pueden contener errores gramaticales que recuerdan a las estafas de phishing, lo que aumenta aún más las dudas sobre su legitimidad.

La falta de transparencia sobre el proceso de aceptación o las APC hace que los autores no sean conscientes de los gastos en los que incurrirán hasta que su artículo sea aceptado, lo que conduce a una posible explotación financiera.

Las revistas depredadoras pueden exigir a los autores que renuncien a los derechos de autor del artículo en el momento de presentarlo, impidiendo así que los autores envíen su trabajo a otras editoriales.

Algunas revistas depredadoras publican artículos enviados antes de que los autores hayan firmado los acuerdos de publicación, y luego se niegan a retirar los artículos si los autores retiran sus envíos.

Las revistas depredadoras pueden retirar artículos o revistas enteras de la web sin avisar ni informar a los autores, lo que puede provocar la pérdida de acceso a los trabajos publicados y socavar la integridad académica.

Uno se preguntaría, sabiendo que la revista no es fiable y que puede no proporcionar la asistencia editorial necesaria, ¿por qué un investigador acabaría publicando con ellos? ¿Qué atraería a un investigador a publicar con una editorial fraudulenta? Técnicamente, ¡nada! Esperaría a tener su oportunidad y a que una buena editorial estuviera dispuesta a aceptar la infravaloración de su investigación. A nuestro entender, ningún factor causal puede llevar a un investigador a desperdiciar toda su vida y entregársela a un editor depredador. Pero sí vemos que se producen publicaciones. Cuando tratamos de buscar los motivos, encontramos que las razones más destacadas son las siguientes.

En el mundo académico, a menudo se hace especial hincapié en la publicación de trabajos de investigación para avanzar en la carrera profesional, conseguir financiación u obtener reconocimiento. Los autores sometidos a presión para publicar pueden ser más susceptibles a las solicitudes de revistas depredadoras, especialmente si ofrecen una publicación rápida con obstáculos mínimos.

Cuando se está en el último año de doctorado y la convocatoria depende de la publicación, la presión es enorme. Bajo una inmensa tensión y presión para graduarse, existe la posibilidad de que una vez se pasen por alto ciertos indicadores de publicación depredadora y se pasen por alto correos electrónicos obvios con faltas de ortografía.

Es necesario que los mentores echen una mano a los estudiantes y les ayuden a superar la presión y a ceñirse a un procedimiento de publicación. Publicar con una editorial de renombre y un consejo editorial prestigioso puede aportar una nueva luz a la carrera de los estudiantes. Todos los esfuerzos de un largo viaje de investigación pueden necesitar un último golpe de timón para buscar la editorial adecuada.

El desconocimiento puede ser un factor importante que contribuya a que los autores publiquen inadvertidamente en revistas depredadoras. Los investigadores noveles o los que proceden de regiones poco familiarizadas con las prácticas de publicación académica pueden desconocer la existencia o las características de las revistas depredadoras. Sin una orientación o tutoría adecuadas, pueden ser víctimas de prácticas engañosas.

Además, los autores cuya lengua materna no es el inglés pueden tener dificultades para navegar por las complejidades de la publicación académica, incluida la identificación de revistas acreditadas. Las revistas depredadoras pueden aprovecharse de esta vulnerabilidad dirigiéndose a los hablantes no nativos de inglés con ofertas tentadoras e información engañosa. A pesar de los crecientes esfuerzos por concienciar sobre la publicación abusiva, no todos los investigadores están bien informados sobre las características y los riesgos asociados a las revistas abusivas. Si no se les educa en este tema, es posible que, sin darse cuenta, los autores se pongan en contacto con editoriales depredadoras.

Al estar atentos y ser minuciosos en la evaluación de las revistas, los investigadores pueden evitar ser presa de prácticas depredadoras y asegurarse de que su investigación se difunde a través de canales acreditados. También es importante evitar citar artículos de investigación de esas revistas para crear una bibliografía más auténtica. El investigador también debe vigilar para restringir el uso de este tipo de revistas y ponerlo en conocimiento de sus colegas.

Evitar la publicación predatoria es el primer paso hacia su publicación. Una vez que lo haya superado y haya identificado la revista en la que desea publicar su investigación, le espera el viaje más interesante. Suscríbase a nuestro blog para obtener información interesante sobre la redacción de artículos de investigación. Mind the Graph está aquí para ayudarle con artículos de orientación y, por supuesto, la elaboración de resúmenes gráficos para que su artículo resulte interesante.

Nuestro equipo le ayudará a crear impresionantes gráficos para explicar su investigación y conseguir también sus mejores oportunidades de publicación. Póngase en contacto con nosotros para cualquier consulta y pruebe nuestra plataforma de forma gratuita. aquí!

Martin Luther King Jr. fue una figura destacada del movimiento por los derechos civiles del siglo XX, célebre por su inquebrantable compromiso con la protesta no violenta y su defensa de la igualdad racial y la justicia social. Con sus elocuentes discursos, incluido el emblemático "Tengo un sueño", King inspiró a millones de personas a unirse a la lucha contra la discriminación racial y la opresión sistémica. Su incansable activismo condujo a importantes victorias legislativas, como la aprobación de la Ley de Derechos Civiles de 1964 y la Ley del Derecho al Voto de 1965, que ayudaron a desmantelar la segregación y la privación de derechos institucionalizadas.

Los entusiastas de la ciencia de Martin Luther King pueden profundizar en su legado e impacto en el movimiento por los derechos civiles visitando "La Ley de Derechos Civiles de 1964 y la Ley de Derecho al Voto de 1965“.

El trabajo y los logros de Martin Luther King resuenan mucho más allá del ámbito de los derechos civiles, sirviendo de poderoso recordatorio de la perdurable importancia de la justicia, la igualdad y la dignidad humana en la sociedad. El legado de King nos recuerda el papel vital que desempeñan los científicos a la hora de abordar los retos sociales y éticos. Su defensa de la igualdad y la justicia subraya la necesidad de que la ciencia sea integradora, equitativa y socialmente responsable, y de que los investigadores trabajen activamente para hacer frente a las disparidades y promover la diversidad en los campos científicos. Al igual que King, los científicos tienen el potencial de impulsar un cambio positivo y promover el bienestar colectivo de la sociedad a través de su compromiso con la verdad, la integridad y la búsqueda del conocimiento para la mejora de todos.

Las enseñanzas de Martin Luther King Jr. sobre la no violencia han influido en los estudios psicológicos, desempeñando un papel fundamental en la investigación de los mecanismos psicológicos que subyacen a la resistencia pacífica y al cambio social. Su defensa de las tácticas de protesta no violentas, basadas en principios de amor, empatía y convicción moral, inspiró a los psicólogos a investigar los factores cognitivos, emocionales y conductuales que contribuyen a la eficacia de la acción no violenta.

Los psicólogos que estudiaron el movimiento por los derechos civiles intentaron comprender la dinámica psicológica subyacente a estas acciones no violentas y su impacto en el cambio social. Por ejemplo, la investigación llevada a cabo por el psicólogo social Gordon Allport exploró el papel del contacto intergrupal y la empatía en la reducción de los prejuicios y la promoción de actitudes positivas hacia la integración racial. Para obtener información más completa sobre la hipótesis del contacto intergrupal de Allport, acceda a "La hipótesis del contacto intergrupal de Allport: Su historia e influencia“.

Además, los estudios del psicólogo Philip Zimbardo examinaron los procesos psicológicos que contribuyeron al éxito de las tácticas de protesta no violentas, destacando la importancia de la convicción moral, la solidaridad y la acción colectiva para movilizar a las comunidades y lograr la transformación social. Estos estudios de casos ponen de relieve la profunda influencia de las enseñanzas de King en la investigación psicológica sobre la no violencia, aportando valiosos conocimientos sobre la psicología de los movimientos sociales y la promoción de la paz y la justicia. Para más detalles sobre el estudio de Zimbardo, visite: "Experimento de la prisión de Stanford: El famoso estudio de Zimbardo“.

La filosofía de la no violencia de Martin Luther King Jr. ha tenido una profunda influencia en las teorías y estudios sociológicos, dando forma a la comprensión académica de los movimientos sociales, la dinámica del poder y la acción colectiva. La defensa de King de las tácticas de protesta no violentas, basadas en principios de amor, empatía y convicción moral, desafió las nociones predominantes de cambio social y resistencia. Los sociólogos inspirados por las enseñanzas de King han estudiado la dinámica de los movimientos sociales y el papel de la resistencia no violenta en la lucha contra la injusticia y la desigualdad sistémicas.

La insistencia de King en el imperativo moral de la no violencia ha suscitado investigaciones sociológicas sobre la ética del activismo social, la construcción de la identidad colectiva y la interacción entre ideología y cambio social. En general, el legado de King sigue dando forma a las teorías y estudios sociológicos, ofreciendo valiosas perspectivas sobre las complejidades de los movimientos sociales y la búsqueda de la justicia en la sociedad contemporánea.

Los sociólogos han estudiado en profundidad este periodo crucial de la historia estadounidense, analizando las estrategias, tácticas y resultados del movimiento desde una perspectiva sociológica. Inspirada por el énfasis de King en la resistencia no violenta, la investigación sociológica ha explorado cómo el movimiento por los derechos civiles movilizó a diversos grupos de individuos, desafió estructuras de poder arraigadas y galvanizó a la opinión pública para lograr el cambio social. Por ejemplo, el sociólogo Aldon MorrisAldon Morris, en su obra seminal "Los orígenes del Movimiento por los Derechos Civiles", examina el papel del activismo de base y la acción colectiva en el impulso del movimiento, destacando la importancia de las tácticas de protesta no violentas en la configuración de su trayectoria. Aquí puede encontrar más información sobre Aldon Morris: "El Dr. Aldon Morris habla sobre el Movimiento por los Derechos Civiles y su relación con Black Lives Matter“.

Aunque Martin Luther King Jr. es conocido sobre todo por su liderazgo en el movimiento por los derechos civiles y su defensa de la justicia social, también compartió ideas sobre tecnología en algunos de sus discursos y escritos. En su discurso "El sueño americano", pronunciado en 1961, King abordó los rápidos avances de la tecnología y su impacto en la sociedad. Reconoció el potencial de la tecnología para mejorar el nivel de vida y la comunicación, pero también expresó su preocupación por su potencial para exacerbar la desigualdad y deshumanizar a las personas. King subrayó la importancia de aprovechar las innovaciones tecnológicas para mejorar la humanidad e instó a un acceso equitativo a los recursos tecnológicos.

Sus perspectivas sobre la tecnología resuenan en los debates contemporáneos en torno a las implicaciones éticas de los avances tecnológicos, incluidas cuestiones como la brecha digital, la preocupación por la privacidad y el uso ético de la inteligencia artificial. El llamamiento de King a un uso ético y responsable de la tecnología sirve como recordatorio intemporal de la necesidad de dar prioridad a la dignidad humana y la justicia social en el desarrollo y despliegue de las innovaciones tecnológicas en la actualidad.

Martin Luther King creía que la ciencia en sí misma era neutral, es decir, que no era ni intrínsecamente buena ni mala. Su impacto dependía de las intenciones y los valores de quienes la utilizaban. Afirmaba que cuando la ciencia se separaba de las consideraciones morales, podía utilizarse para perpetuar la opresión y la violencia, como en el caso del desarrollo de armas mortíferas.

Sin embargo, King también vio el potencial de la ciencia para ser una fuerza de cambio positivo. Afirmaba que, guiada por principios éticos, en particular la ética del amor, la ciencia podía contribuir a mejorar la humanidad. Esto incluía la mejora del nivel de vida, el avance de nuestra comprensión del mundo y el fomento de la unidad entre las personas. En esencia, King abogaba por un enfoque concienzudo del avance científico, que diera prioridad a los valores morales y al bienestar de la sociedad por encima del mero progreso tecnológico.

Un ejemplo significativo de la influencia de la tecnología fue el uso generalizado de la televisión y la radio para difundir los discursos y sermones de King a una audiencia nacional. Gracias a sus apariciones en televisión y sus emisiones de radio, King pudo llegar a millones de estadounidenses, traspasando las barreras geográficas y movilizando el apoyo a la causa de los derechos civiles. Además, los avances en la tecnología de impresión facilitaron la distribución de panfletos, folletos y boletines con los escritos y discursos de King, lo que permitió que su mensaje llegara a los activistas de base y a las comunidades de todo el país.

El uso de la comunicación telefónica y la telegrafía permitió a los organizadores de los derechos civiles coordinar protestas, marchas y boicots en tiempo real, facilitando la rápida movilización de los activistas y amplificando el impacto de las estrategias de resistencia no violenta. En general, la tecnología desempeñó un papel crucial a la hora de amplificar el mensaje de King y galvanizar el apoyo al movimiento por los derechos civiles, demostrando su poder como herramienta para el cambio social y la movilización en pos de la justicia y la igualdad.

Martin Luther King Jr. no habló extensamente de ciencia en sus discursos o escritos, pero sus opiniones filosóficas más amplias sobre la justicia, la igualdad y el cambio social permiten comprender su perspectiva sobre el papel de la ciencia en la sociedad. King creía en el poder transformador del conocimiento y la educación como catalizadores del progreso y la liberación social. Aunque no abordó explícitamente el papel de la ciencia, su énfasis en el pensamiento crítico, las pruebas empíricas y el razonamiento moral sugiere un reconocimiento implícito de la ciencia como herramienta para comprender y abordar las injusticias sociales. Es probable que King considerara la ciencia como una fuerza potencial de liberación si se empleaba de forma ética y responsable para mejorar el bienestar humano, promover la igualdad y cuestionar los sistemas opresivos.

Sin embargo, también podría haber reconocido el riesgo de que la ciencia fuera cooptada o utilizada indebidamente para perpetuar la opresión, por ejemplo mediante la proliferación de ideologías discriminatorias o tecnologías que refuerzan las estructuras de poder existentes. La visión de King de una sociedad justa y equitativa probablemente habría hecho hincapié en la importancia de aprovechar el conocimiento científico y la innovación al servicio de la humanidad, abogando al mismo tiempo por unas directrices éticas y una responsabilidad social que garanticen que los avances científicos benefician a todos los miembros de la sociedad. Aunque la influencia directa de King en la comunidad científica puede ser limitada, sus principios morales y éticos siguen inspirando a científicos e investigadores para que consideren las implicaciones sociales más amplias de su trabajo y defiendan la ciencia como una fuerza para el cambio positivo y la liberación.

Las contribuciones de Martin Luther King Jr. al debate sobre la ética en la investigación científica son polifacéticas y están enraizadas en su filosofía más amplia de justicia, igualdad y responsabilidad social. Aunque King no abordó directamente las consideraciones éticas en la investigación científica, sus principios morales y éticos han configurado sin duda el panorama ético de la investigación científica.

Un ejemplo de la influencia de King es su insistencia en el valor y la dignidad inherentes a todo individuo, que subraya la importancia de respetar los derechos humanos y la autonomía en la investigación científica. La defensa de King de la no violencia y la justicia social también pone de relieve el imperativo ético de que los científicos tengan en cuenta las posibles repercusiones sociales de su investigación y den prioridad al bienestar de las comunidades marginadas. Los llamamientos de King a la inclusión y la diversidad en la sociedad resuenan con los esfuerzos para promover la diversidad, la equidad y la inclusión en la investigación científica, haciendo hincapié en la importancia de las diversas perspectivas y la representación en la conformación de las agendas y prioridades de investigación.

El compromiso de King con la verdad y la integridad en la búsqueda de la justicia recuerda a los científicos su responsabilidad ética de investigar con honestidad, transparencia e integridad, y de respetar las normas éticas en todos los aspectos de su trabajo. En general, aunque King no abordara directamente las consideraciones éticas en la investigación científica, sus principios morales y éticos han influido indudablemente en el panorama ético de la investigación científica, inspirando a los científicos a considerar las implicaciones sociales más amplias de su trabajo y a esforzarse por alcanzar la excelencia ética en sus esfuerzos de investigación.

Mind the Graph ofrece una ayuda inestimable a los científicos al proporcionarles acceso a una amplia biblioteca de más de 75.000 figuras científicas precisas. Esta completa colección proporciona a los investigadores una gran variedad de elementos visuales de alta calidad, como diagramas, ilustraciones y gráficos, que pueden integrar perfectamente en su trabajo. Gracias a estos atractivos recursos visuales, los científicos pueden mejorar la claridad y eficacia de sus presentaciones, artículos y comunicaciones, aumentando así significativamente su repercusión en sus respectivos campos.

En una era dominada por los acuciantes retos del cambio climático, el panorama agrícola experimenta una dramática inestabilidad para garantizar la resiliencia, la sostenibilidad y la producción. Este artículo explora las complejidades de la agricultura climáticamente inteligente (CSA), un concepto que integra la adaptación, la mitigación y la resiliencia en las prácticas agrícolas.

A medida que aumentan las temperaturas globales y varían los patrones meteorológicos, la necesidad de crear un futuro agrícola sostenible y resistente al clima nunca ha sido más urgente. Este examen intenta arrojar luz sobre por qué adoptar una agricultura climáticamente inteligente no es simplemente una opción, sino un paso esencial para asegurar nuestro suministro de alimentos y cultivar un paradigma agrícola respetuoso con el planeta.

A medida que el clima de la Tierra sigue adaptándose de formas inesperadas, la agricultura se encuentra en la vanguardia de un mundo en rápida transformación. La delicada danza entre el cambio climático y la agricultura es una interacción dinámica y polifacética que reconfigura no sólo las prácticas agrícolas existentes, sino que también tiene un impacto significativo en el futuro de la producción de alimentos.

El cambio climático, en sus diversos comportamientos, tiene un impacto complejo en la agricultura, enviando ondas a través de las perspectivas actuales y futuras de este sector crítico. La compleja interacción se presenta como una historia de dificultades y ajustes, que requiere una mirada más atenta a la forma en que las prácticas agrícolas deben evolucionar para satisfacer las demandas de un clima en constante cambio.

Veamos la interacción dinámica entre el cambio climático y la agricultura, estudiando las sutiles formas en que estas fuerzas se entrecruzan y configuran el paisaje agrícola.

La agricultura, crucial para la existencia humana, contribuye paradójicamente de forma significativa al cambio climático. Esta relación implica la emisión de gases de efecto invernadero, la deforestación, el cambio del uso de la tierra y un importante consumo de energía.

En respuesta a los retos que plantea el cambio climático, el sector agrícola está adoptando prácticas innovadoras que no sólo se adaptan al clima cambiante, sino que también contribuyen a los esfuerzos de mitigación. Estas prácticas de agricultura climáticamente inteligente dan prioridad a la sostenibilidad y la resiliencia.

La Agricultura Climáticamente Inteligente (CSA, por sus siglas en inglés) es un enfoque agrícola integrado y adaptativo que pretende abordar los problemas del cambio climático al tiempo que promueve prácticas agrícolas sostenibles y resilientes. Supone la aplicación coordinada de iniciativas que aumentan la producción, reducen las emisiones de gases de efecto invernadero y refuerzan la resistencia a los efectos del cambio climático.

Los ejemplos siguientes muestran cómo cada práctica agrícola climáticamente inteligente contribuye a mejorar la resiliencia, la sostenibilidad y la adaptabilidad frente a un clima cambiante.

La aplicación de la agricultura climáticamente inteligente requiere la adopción de prácticas y principios estratégicos destinados a reforzar la resiliencia agrícola, mitigar los efectos del cambio climático y garantizar la sostenibilidad a largo plazo. Estas son las estrategias clave para aplicar eficazmente la agricultura climáticamente inteligente.

Mediante la incorporación sistemática de estas estrategias, la colaboración entre agricultores, responsables políticos y comunidades puede contribuir a la creación de un sistema agrícola resistente y sostenible, bien equipado para prosperar ante los retos que plantea el cambio climático.

Para hacer frente a los graves retos que plantea el cambio climático, la agricultura se encuentra en una encrucijada que requiere innovación, resiliencia y un compromiso inquebrantable con la sostenibilidad. El análisis de la Agricultura Climáticamente Inteligente (CSA) en este artículo muestra un enfoque dinámico que incorpora a la perfección la adaptación, la mitigación y la resiliencia en las prácticas agrícolas.

A medida que aumentan las temperaturas globales y varían los patrones meteorológicos, se hace evidente la necesidad de crear un futuro agrícola sostenible y resistente al clima.

El cambio climático y la agricultura mantienen una relación compleja, que incluye temperaturas extremas, cambios en el régimen de precipitaciones, escasez de agua y aumento de la presión de las plagas, todo lo cual repercute en las prácticas actuales. De cara al futuro, los cambios previstos en las zonas de cultivo, la reducción de la diversidad de cultivos, los fenómenos meteorológicos extremos y los problemas de seguridad alimentaria mundial crean un panorama difícil que exige medidas proactivas.

Reconocer el paradójico papel de la agricultura en el cambio climático, con contribuciones considerables a las emisiones de gases de efecto invernadero, la deforestación y el uso de energía, subraya la importancia de las acciones transformadoras. La agricultura climáticamente inteligente surge como una solución integral para resolver los múltiples retos de la agricultura.

Sin embargo, este viaje revolucionario no está exento de desafíos. Hay que hacer frente a las limitaciones de recursos financieros, los obstáculos tecnológicos, la falta de voluntad de cambio y las incertidumbres políticas.

El camino a seguir requiere colaboración, innovación y un compromiso firme para establecer un paradigma de agricultura responsable con el medio ambiente.

Mind the Graph libera el poder de la comunicación visual, ¡dando vida a tus creaciones en cuestión de minutos! La eficacia de Mind the Graph se hace evidente en sus plantillas prediseñadas y en las sencillas funciones de arrastrar y soltar, que garantizan que sus imágenes no sólo sean impactantes, sino que también se creen con una facilidad inigualable. Mejore sus habilidades de comunicación en los negocios, el mundo académico y la educación: ¡Mind the Graph transforma sus pensamientos en obras maestras visualmente impresionantes!

En el mundo actual de la investigación científica, no se puede subestimar el poder de la comunicación visual. La capacidad de presentar datos complejos de forma visualmente atractiva y fácilmente comprensible es crucial para transmitir eficazmente los resultados de la investigación. Aquí es donde entra en juego Mind the Graph. Mind the Graph es una plataforma en línea que está revolucionando la visualización de datos científicos. Dirigida a científicos e investigadores, la plataforma ofrece una interfaz fácil de usar para crear figuras científicas, infografías, resúmenes gráficos, presentaciones y pósters visualmente cautivadores. Está dirigida a particulares, pequeños laboratorios y grandes organizaciones, lo que la hace accesible a una amplia gama de públicos dentro de la comunidad científica. Lo que distingue a Mind the Graph es su capacidad para afrontar el reto que supone para los investigadores visualizar datos científicos complejos sin conocimientos especializados de diseño. Al ofrecer una serie de herramientas intuitivas y plantillas infográficas educativas, la plataforma permite a los investigadores crear fácilmente imágenes visualmente atractivas que mejoran la comunicación científica. Con ello, Mind the Graph está redefiniendo la forma de presentar y compartir la investigación científica, impulsando en última instancia los avances científicos.

El objetivo principal de Mind the Graph es simplificar el proceso de visualización de datos científicos. La plataforma está diseñada para hacer más digeribles los datos científicos complejos transformándolos en gráficos visualmente atractivos y fácilmente comprensibles. El objetivo es ayudar a los investigadores a difundir sus hallazgos de manera más eficaz y atractiva, facilitando así una mejor comprensión y aumentando el impacto de su trabajo.

Mind the Graph tiene la misión de democratizar la visualización de datos científicos proporcionando una interfaz intuitiva y herramientas versátiles que no requieren conocimientos avanzados de diseño. Esta accesibilidad permite a los investigadores centrarse en su trabajo principal, con la seguridad de que pueden representar sus datos con eficacia y precisión de una manera visualmente atractiva.

En última instancia, la plataforma pretende hacer avanzar la comunicación científica salvando la distancia entre los datos complejos y su comprensión. Al permitir una visualización clara y cautivadora de los datos científicos, la herramienta está contribuyendo significativamente a la proliferación del conocimiento en la comunidad científica, fomentando la colaboración y acelerando los avances científicos.

El público objetivo principal de Mind the Graph abarca un amplio espectro de la comunidad científica. Esto incluye a investigadores individuales, pequeños laboratorios de investigación y grandes organizaciones científicas. La utilidad de la plataforma no se limita a una disciplina científica específica, por lo que es una herramienta inestimable para científicos de diversos campos de estudio, como la biología, la física, la química y las ciencias de la tierra, entre otros.

Además de a científicos e investigadores, la plataforma también se dirige a educadores del ámbito científico. Profesores, conferenciantes y maestros pueden utilizar Mind the Graph para crear materiales didácticos visualmente atractivos que ayuden a transmitir eficazmente los conceptos científicos a sus aulas y a las distintas clases de alumnos.

Además, Mind the Graph es igualmente beneficioso para comunicadores científicos y periodistas que necesitan transmitir información científica a un público general de una forma visual que sea fácil de entender pero precisa. Al transformar datos científicos complejos en infografías y figuras visualmente atractivas, pueden garantizar que el contenido científico sea accesible y atractivo para todos.

Para resumir los consejos de esta entrada de blog, cualquiera que trabaje con datos científicos y necesite gráficos visualmente convincentes para presentar su información de forma eficaz puede beneficiarse del uso de Mind the Graph.

Una característica destacada de Mind the Graph es su especial atención a la facilidad de uso. Reconociendo que no todos los científicos e investigadores tienen conocimientos avanzados de diseño, la plataforma está diseñada para ser fácilmente navegable e intuitiva. Esto garantiza que los usuarios puedan crear figuras científicas, infografías y presentaciones visualmente atractivas sin tener que enfrentarse a una curva de aprendizaje empinada.

La plataforma ofrece una amplia gama de plantillas infográficas prediseñadas que se adaptan a diversas necesidades y campos de investigación. Los usuarios pueden seleccionar sin esfuerzo una plantilla de infografía completa que se adapte a sus necesidades y luego personalizarla con sus datos. Esta simplicidad se complementa con un sólido conjunto de herramientas que permite a los usuarios modificar y adaptar los gráficos a sus necesidades específicas, todo ello dentro de una interfaz sencilla y fácil de usar.

Además, los novatos en visualización de datos no se quedan desamparados. Mind the Graph también ofrece una gran cantidad de recursos educativos gratuitos, como tutoriales, consejos y guías, para ayudar a los usuarios a ponerse al día con la plataforma y los principios de la visualización de datos eficaz. Este compromiso con la facilidad de uso garantiza que Mind the Graph puede ser una potente herramienta para cualquier científico o investigador que desee mejorar su comunicación científica con imágenes impactantes.

En el ámbito de la investigación científica, la comunicación es clave. La capacidad de transmitir eficazmente los resultados de la investigación no sólo mejora la comprensión, sino que también impulsa el discurso científico. Mind the Graph desempeña un papel crucial en este aspecto, transformando la comunicación científica en una experiencia más atractiva.

Lo visual tiene una ventaja inherente en la comunicación: el cerebro humano lo procesa mucho más rápido que el texto. Aprovechando esta ventaja, Mind the Graph permite a los investigadores presentar sus datos complejos en formatos visualmente atractivos, utilizando ejemplos como infografías, resúmenes gráficos y figuras. Este enfoque visual no sólo mejora la comprensión de los datos, sino que también capta y mantiene la atención de la audiencia, con lo que la comunicación resulta más atractiva.

Además, la interfaz fácil de usar y las plantillas personalizables de la plataforma dan a los investigadores libertad para expresar y explorar su creatividad en sus presentaciones. Esto añade un toque único a su trabajo, haciéndolo más atractivo para el público y diferenciándolo de las presentaciones científicas convencionales.

En esencia, Mind the Graph está redefiniendo la comunicación científica haciéndola más atractiva visualmente, lo que aumenta el impacto y el alcance de la investigación científica.

La visualización de datos en la investigación científica suele plantear numerosos retos, sobre todo cuando se trata de conjuntos de datos complejos. Los investigadores pueden tener dificultades para decidir cuál es la mejor manera de representar sus datos, garantizar la exactitud de la representación y hacer que las imágenes sean atractivas y comprensibles. Mind the Graph aborda estos retos de frente, proporcionando una visión rápida de soluciones prácticas para los investigadores.

La plataforma ofrece una variedad de plantillas prediseñadas que pueden adaptarse a distintos tipos de datos y campos de investigación. Estas plantillas sirven como punto de partida, eliminando el obstáculo inicial de decidir cómo representar los datos. A partir de ahí, las herramientas y funciones intuitivas permiten a los investigadores personalizar varias versiones de las plantillas para adaptarlas con precisión a sus datos y resultados de investigación específicos.

Además, Mind the Graph entiende la importancia de que los datos científicos sean accesibles y comprensibles para un público amplio. Con este fin, la interfaz y las herramientas de la plataforma están diseñadas para ayudar a los investigadores a crear gráficos visualmente atractivos y fácilmente comprensibles. Esto incluye funciones como la selección de colores, opciones de fuentes y personalización de formas que pueden mejorar significativamente el atractivo visual y la claridad de la representación de los datos.

En esencia, Mind the Graph actúa como un valioso aliado para los investigadores, ayudándoles a superar los retos habituales asociados a la visualización de datos científicos.

La integración de Mind the Graph en el proceso de investigación científica es sencilla y beneficiosa. La interfaz de la plataforma es fácil de usar y cuenta con una gran variedad de herramientas y plantillas, por lo que los investigadores pueden incorporarla fácilmente a su flujo de trabajo para crear atractivas representaciones visuales de sus datos.

El proceso comienza con la selección de una plantilla que se ajuste a las necesidades específicas del investigador. Una vez seleccionada la plantilla, los investigadores pueden introducir sus datos, modificar los gráficos y personalizar los elementos visuales para representar y explicar con precisión sus conclusiones. El conjunto de herramientas de la plataforma permite afinar los detalles, garantizando que los elementos visuales creados reflejen los datos con precisión y transmitan la información de la manera más eficaz.

Más allá de la visualización de datos de investigación, Mind the Graph también puede utilizarse para crear atractivas presentaciones y pósters para conferencias y reuniones. Al aprovechar las capacidades de la plataforma, los investigadores pueden asegurarse de que su trabajo destaque y sea bien recibido por sus colegas, mejorando así su comunicación científica y su impacto.

En resumen, la integración de Mind the Graph en el proceso de investigación puede mejorar significativamente la visualización y presentación de los datos científicos, contribuyendo así a la comunicación y difusión eficaces de los resultados de la investigación.

La comunicación visual en la investigación científica desempeña un papel importante en la mejora de la accesibilidad y el compromiso. Al transformar datos complejos en gráficos visualmente atractivos y fácilmente comprensibles, los investigadores pueden comunicar eficazmente sus hallazgos a un público mucho más amplio.

Mind the Graph facilita este proceso, proporcionando una serie de herramientas y plantillas infográficas que permiten crear atractivas representaciones visuales de los datos científicos. Esto no sólo hace que los datos sean más digeribles, sino que también hace que los hallazgos científicos sean más accesibles para las personas sin formación científica. Esta accesibilidad es crucial en el mundo interconectado de hoy, en el que los descubrimientos científicos a menudo tienen implicaciones que van más allá de la comunidad científica.

Además, los gráficos visualmente atractivos pueden aumentar significativamente el compromiso de la audiencia. Al captar la atención de la audiencia y facilitar la comprensión de conceptos complejos, los elementos visuales pueden estimular el debate, animar a compartir los hallazgos e incluso inspirar nuevas investigaciones. De este modo, la comunicación visual, facilitada por plataformas como Mind the Graph, puede aumentar significativamente el impacto y el alcance de la investigación científica.

En última instancia, el uso de la comunicación visual en la investigación científica, especialmente a través de plataformas de fácil uso como Mind the Graph, puede contribuir en gran medida a la accesibilidad y el compromiso de los resultados de la investigación.

El uso de la comunicación visual en la investigación científica, especialmente a través de plataformas como Mind the Graph, aporta múltiples ventajas a la comunidad científica. La principal es la mejora de la comunicación científica. Al transformar datos complejos en gráficos visualmente atractivos, los investigadores pueden comunicar eficazmente sus hallazgos a sus colegas, fomentando una mejor comprensión y estimulando el discurso científico.

Además, la accesibilidad que proporciona la comunicación visual abre la comunidad científica a un público más amplio. Esto puede aumentar el interés del público y su comprensión de la investigación científica, fomentando una cultura de alfabetización, educación y apreciación científicas.

La comunicación visual también facilita la colaboración interdisciplinar. Al presentar los datos en un formato visualmente comprensible, los investigadores pueden comunicar eficazmente sus hallazgos a colegas de distintas disciplinas científicas. Esto puede dar lugar a colaboraciones que tiendan puentes entre disciplinas, fomentando la innovación y el avance de la investigación científica.

Por último, el uso de plataformas como Mind the Graph puede mejorar la eficiencia dentro de la comunidad científica. Al proporcionar una plataforma eficiente y fácil de usar para la visualización de datos, los investigadores pueden ahorrar tiempo y recursos que pueden utilizar mejor para sus actividades de investigación básicas.

En esencia, el uso de la comunicación visual en la investigación científica, especialmente a través de plataformas como Mind the Graph, tiene el potencial de mejorar significativamente la eficacia, el alcance y la eficiencia de la comunidad científica.

El impacto de la comunicación visual en la investigación científica, facilitado por plataformas como Cuidado con el gráficoLa mejor forma de ilustrarlo es a través de historias de éxito y testimonios de la comunidad científica.

Muchos investigadores han alabado la plataforma por su facilidad de uso y su eficacia a la hora de comunicar datos complejos. Por ejemplo, un investigador del campo de la genómica expresó cómo la plataforma le permitía representar visualmente secuencias genómicas intrincadas de forma comprensible y visualmente atractiva. Esto no sólo mejoró la presentación del investigador, sino que también estimuló debates e ideas interesantes entre compañeros.

Los educadores del ámbito científico también han elogiado Mind the Graph. Un profesor de biología utilizó la plataforma para crear atractivos materiales didácticos y señaló que los gráficos visualmente atractivos y comprensibles mejoraban significativamente el compromiso de los estudiantes y su comprensión de conceptos biológicos complejos.

Del mismo modo, un divulgador científico relató cómo la plataforma le permitió transmitir eficazmente hallazgos científicos complejos a un público general. El uso de infografías educativas visualmente cautivadoras facilitó la comprensión y estimuló el interés de los lectores, mejorando el impacto de sus esfuerzos profesionales de comunicación científica.

Estas historias de éxito y testimonios ponen de relieve los importantes beneficios de la comunicación visual en la investigación científica, sobre todo cuando se ve facilitada por plataformas fáciles de usar, divertidas y eficaces como Mind the Graph. Regístrate gratis y pruébalo ahora.

Con la rápida difusión de contenidos a través de diversas plataformas, la precisión y la claridad son esenciales. En el mundo actual, impulsado por la información, tanto la corrección de textos como la de pruebas desempeñan un papel importante a la hora de garantizar la credibilidad y la eficacia de la comunicación escrita. La corrección de textos refina la calidad general del contenido, haciéndolo claro, coherente y atractivo, cualidades esenciales en medio de la abundancia de información. Por su parte, la corrección de pruebas actúa como última salvaguarda, evitando errores que podrían socavar la credibilidad del mensaje. En una era en la que la información se consume y se comparte con rapidez, los esfuerzos conjuntos de la corrección y la corrección de pruebas garantizan no sólo un contenido sin errores, sino también una transmisión eficaz de los mensajes deseados, fomentando la confianza y la fiabilidad en el intercambio de información instantánea.

La corrección de textos es un proceso editorial que perfecciona el contenido escrito para conseguir claridad, coherencia y cumplimiento de las normas de estilo establecidas. Como intermediario entre la intención del autor y la comprensión del público, el corrector realiza diversas tareas, como corregir la gramática y la sintaxis, garantizar la coherencia del estilo, mejorar la claridad y la coherencia generales, comprobar la exactitud de los hechos, refinar el lenguaje y ajustar los elementos de formato. Esta función polifacética contribuye a transformar un manuscrito en un producto final pulido, sin errores y presentado con profesionalidad.

Gramática y sintaxis: Corregir errores gramaticales, garantizar una estructura adecuada de las frases y eliminar problemas de sintaxis para mejorar la legibilidad.

Coherencia de estilo: Garantizar la coherencia en el uso del lenguaje, el formato y el cumplimiento de una guía de estilo específica.

Claridad y coherencia: Mejorar la claridad y coherencia generales del texto reorganizando o reestructurando frases y párrafos.

Comprobación de hechos: Verificación de la exactitud de los hechos, los datos y las referencias para mantener la credibilidad del contenido.

Ortografía y puntuación: Garantizar una ortografía correcta, una puntuación adecuada y el cumplimiento de las convenciones establecidas.

Pulido del lenguaje: Perfeccionar el lenguaje para adaptarlo al tono, la audiencia y el propósito del documento.

Formato y maquetación: Revisar y ajustar los elementos de formato para crear una presentación visualmente atractiva y coherente.

La corrección de pruebas es la fase final y meticulosa del proceso editorial, dedicada a la revisión y corrección exhaustivas del contenido escrito antes de su publicación. Como último control de calidad, el corrector desempeña un papel fundamental a la hora de garantizar la precisión y la claridad, corrigiendo meticulosamente los errores gramaticales, ortográficos y de puntuación, manteniendo la coherencia en el lenguaje y el formato, y cotejando los detalles para comprobar la veracidad de los hechos.

Gramática y ortografía: Corregir los errores gramaticales, identificar y rectificar las faltas de ortografía y garantizar el uso correcto de los signos de puntuación.

Coherencia: Verificación y mantenimiento de la coherencia en el uso del lenguaje, el formato y el estilo en todo el documento.

Tipografía y formato: Comprobación de errores tipográficos, uso coherente de las fuentes y revisión del formato general del documento para que tenga un aspecto pulido.

Precisión en las referencias: Verificación de la exactitud de las referencias, citas y otros elementos fácticos para mantener la fiabilidad del documento.

Detalles de la verificación cruzada: Referencia cruzada cuidadosa de detalles, como nombres, fechas y números, para garantizar la precisión y la coherencia.

Comprobación final de legibilidad: Realice una comprobación final de la legibilidad y coherencia generales, abordando cualquier problema persistente que pueda afectar a la claridad del documento.

La comparación entre corrección de textos y corrección de pruebas contrasta dos procesos distintos en la edición de contenidos escritos. Aunque tanto la corrección como la corrección de pruebas contribuyen a perfeccionar el contenido escrito, sus objetivos principales y sus áreas de interés varían. La corrección de textos pretende elevar la calidad general del texto abordando cuestiones relacionadas con el estilo, la organización y el uso del lenguaje. La corrección de pruebas, por su parte, se centra específicamente en eliminar errores que podrían haberse pasado por alto en fases anteriores, haciendo hincapié en la corrección y el cumplimiento de las convenciones lingüísticas.

La corrección de textos implica un mayor nivel de detalle y un alcance más amplio, ya que requiere una comprensión exhaustiva del contexto, el estilo y el público al que va dirigido el documento. Puede implicar la reestructuración de frases, la mejora de las transiciones y la garantía de coherencia en todo el texto. Por el contrario, la corrección de pruebas es más detallada y se centra en detectar y corregir errores individuales sin introducir cambios significativos en la estructura o el estilo generales. Juntos, estos procesos contribuyen a crear un material escrito pulido, sin errores y presentado de forma profesional.

Frase original: "La conferencia comenzará a las 14.00 horas y se ruega puntualidad a los asistentes".

Versión corregida: "La conferencia comenzará a las 14.00 horas, y se ruega puntualidad a los asistentes".

Explicación: En este ejemplo, el corrector mejoró la claridad especificando el formato de la hora, ajustó la redacción para darle formalidad y sustituyó "comenzar" por el más común "empezar".

Pasaje original: "A pesar de los innumerables retos a los que se enfrenta la organización, han sabido perseverar y superar cada obstáculo".

Versión corregida: "A pesar de los numerosos retos a los que se ha enfrentado la organización, han perseverado y superado cada obstáculo".

Explicación: El corrector ha simplificado la expresión sustituyendo "miríada de" por "numerosos", lo que hace que la frase sea más concisa y fácil de entender.

Frase original: "El informe se presentó antes de la fecha límite".

Versión corregida: "El informe se presentó antes de la fecha límite".

Explicación: El corrector corrigió el error ortográfico de "informe", garantizando la exactitud en la versión final del documento.

Párrafo original: "El margen de beneficios de la empresa aumentó 15% en el último cuatrienio".

Versión corregida: "El margen de beneficios de la empresa aumentó 15% en el último trimestre".

Explicación: El corrector identificó y rectificó el error tipográfico en "cuarteto", sustituyéndolo por el término correcto, "cuarto".

Errores ortográficos y gramaticales: Las erratas, faltas de ortografía y errores gramaticales suelen pasarse por alto, pero pueden afectar significativamente a la claridad y profesionalidad del texto.

Incongruencias de estilo: Garantice la uniformidad del lenguaje, el formato y el estilo en todo el documento, especialmente cuando se trate de números, fechas y citas.

Fraseología ambigua: Busque frases u oraciones que puedan resultar confusas o ambiguas para los lectores. Aclárelas y reformúlelas para mejorar la comprensión.

Redundancia y Wordiness: Elimine palabras y frases innecesarias para mejorar la claridad y concisión del documento.

Cree una lista de control: Elabore una lista de comprobación de edición personalizada para revisar sistemáticamente los distintos elementos y asegurarse de que no se pasa nada por alto durante el proceso de edición.

Mantenga el control de versiones: Lleve un registro de las ediciones y revisiones para evitar introducir nuevos errores durante el proceso de edición. Mantén un historial de versiones claro como referencia.

Busque opiniones: Colabora con compañeros o colegas para obtener nuevas perspectivas sobre el documento. Los comentarios externos pueden aportar información valiosa y detectar errores pasados por alto.

Preste atención a los detalles: Sea meticuloso al examinar los detalles de puntuación, espaciado y formato. La atención constante a los detalles contribuye a un producto final pulido.

Los profesionales son los guardianes de la precisión lingüística, que refinan meticulosamente los documentos para que cumplan las normas más estrictas. Estos profesionales contribuyen decisivamente al proceso editorial y tienen la responsabilidad de mantener la credibilidad y profesionalidad de cualquier trabajo escrito.

Conocimientos lingüísticos: Un conocimiento profundo de la gramática, la sintaxis y las convenciones lingüísticas es fundamental para una corrección de textos eficaz.

Atención al detalle: Es fundamental prestar una atención meticulosa a los detalles para detectar hasta los errores más sutiles e incoherencias de ortografía, puntuación y formato.

Pensamiento crítico: Los correctores y revisores profesionales tienen la capacidad de evaluar críticamente el contenido, asegurándose de que se ajusta al propósito y a la audiencia previstos.

Familiaridad con las guías de estilo: Conocimiento y cumplimiento de diversas guías de estilo (por ejemplo, APA, MLA, Chicago) es esencial para mantener la coherencia en el uso del lenguaje y el formato.

Mind the Graph revoluciona el panorama de la investigación científica al ofrecer un conjunto de herramientas dinámicas diseñadas para agilizar y mejorar el trabajo de los científicos. En esencia, la plataforma facilita un importante ahorro de tiempo a los investigadores gracias a su innovador uso de plantillas. Esto no sólo acelera el proceso de investigación, sino que también garantiza una presentación coherente y profesional de los datos. Con Mind the Graph, los científicos pueden superar las limitaciones tradicionales del diseño gráfico, que consume mucho tiempo, y centrarse más en el núcleo de su investigación, fomentando en última instancia la eficiencia y la productividad en la comunidad científica.

El promedio de calificaciones (GPA) es una medida crítica que influye profundamente en la trayectoria académica de cada estudiante. Tanto si eres un estudiante de bachillerato que busca ser admitido en prestigiosas universidades como si eres un estudiante universitario que busca la excelencia en sus actividades académicas, entender cómo se calcula el GPA es una habilidad crucial. Va más allá de la simple aritmética e implica consideraciones sobre diversas escalas de calificación, métodos de ponderación y conversiones.

Este artículo pretende ser una guía exhaustiva que explore en profundidad y responda a la pregunta clave "¿Qué es el GPA después de todo?", desde su definición fundamental y sus métodos de cálculo hasta su profundo significado tanto en la escuela secundaria como en la universidad.

La nota media (GPA) es una representación numérica estandarizada del rendimiento académico global de un estudiante. Se utiliza en las instituciones educativas para evaluar y comparar los logros de estudiantes con diversos antecedentes académicos. El GPA se calcula a partir de las calificaciones obtenidas en diversos cursos, proporcionando una medida cuantificable del éxito de un estudiante en sus estudios.

En la mayoría de los casos, el GPA se expresa en una escala de 0,0 a 4,0 en Estados Unidos, siendo 4,0 el GPA más alto alcanzable. Sin embargo, las escalas de calificación pueden diferir en otros países o sistemas educativos. El sistema GPA permite a los colegios, universidades y empleadores evaluar a los solicitantes y candidatos de forma más eficiente, ya que condensa su rendimiento académico en una única puntuación numérica.

Lea también: Cómo solicitar plaza en una escuela de posgrado: Guía completa y explicativa

El cálculo del GPA suele implicar la conversión de las calificaciones en letras (por ejemplo, A, B, C, D) o porcentajes en los puntos de calificación correspondientes (por ejemplo, A = 4,0, B = 3,0, C = 2,0, D = 1,0), y luego el promedio de estos puntos de calificación a través de todos los cursos realizados dentro de un marco de tiempo específico. La puntuación GPA resultante es un factor esencial para determinar la admisión a la universidad, la posibilidad de optar a becas, honores académicos y diversas oportunidades en los ámbitos académico y profesional.

En general, el GPA es una métrica importante que refleja la excelencia académica, la dedicación y la constancia en los estudios de un estudiante, lo que lo convierte en un aspecto vital de su trayectoria educativa y sus perspectivas de futuro.

En el ámbito de la educación, el promedio de calificaciones de la escuela secundaria (GPA) de un estudiante tiene una profunda importancia. Sirve como una medida vital de los logros académicos y desempeña un papel crucial en la admisión a la universidad, las oportunidades de becas y el progreso académico en general. Comprender el GPA de la escuela secundaria y los factores que influyen en él puede tener un impacto significativo en la trayectoria educativa y las perspectivas de futuro de un estudiante.

El GPA de la escuela secundaria es una representación numérica del rendimiento académico acumulado de un estudiante durante sus años de escuela secundaria. Cuantifica sus calificaciones en todos los cursos, proporcionando una puntuación media que refleja su éxito académico general. Por lo general, los GPA de la escuela secundaria se calculan en una escala de 0,0 a 4,0, donde 4,0 es el GPA más alto alcanzable, lo que indica una puntuación perfecta.

Las notas de bachillerato suelen calcularse utilizando dos escalas principales: ponderadas y no ponderadas. La diferencia radica en el peso adicional que se da a determinados cursos, lo que afecta al cálculo del GPA.

Las medias de calificaciones proporcionan un resumen esclarecedor de los logros académicos de un estudiante. Al condensar múltiples calificaciones en un único valor numérico, ofrecen una evaluación rápida del rendimiento general de un estudiante. Un GPA más alto sugiere una excelencia constante, mientras que un GPA más bajo puede indicar un margen de mejora.

Son varios los factores que influyen en el promedio académico de un estudiante:

La nota media puede variar en función del centro educativo y de la población estudiantil. Puede oscilar entre 2,5 y 3,5 en muchos institutos, con algunos casos excepcionales que superan el 4,0 en centros que emplean GPA ponderadas.

Para obtener una nota media perfecta de 4,0 es necesario obtener calificaciones de sobresaliente en todas las asignaturas a lo largo de la educación secundaria. Este logro excepcional refleja la dedicación y la excelencia académica de un estudiante, lo que los distingue en las solicitudes universitarias y las consideraciones de becas.

A medida que los estudiantes pasan a la enseñanza superior, la importancia de las notas medias universitarias (GPA) adquiere nuevas dimensiones. Los promedios universitarios son un indicador fundamental del rendimiento académico del estudiante durante su trayectoria universitaria. Comprender en qué se diferencian los promedios universitarios de los de la escuela secundaria y los diversos factores que influyen en su cálculo es esencial para que los estudiantes afronten los retos y las oportunidades de la experiencia universitaria.

El GPA universitario, al igual que el del instituto, es una representación numérica de los logros académicos de un estudiante. Sin embargo, en la universidad, la escala del GPA puede diferir de la escala tradicional de 4,0 puntos. Normalmente oscila entre 0,0 y 4,0, pero también puede incluir valores adicionales como 4,3 o 5,0, especialmente cuando se consideran cursos ponderados.

Aunque tanto el GPA de la escuela secundaria como el de la universidad evalúan el rendimiento académico, hay varias diferencias clave que los diferencian:

Las horas de crédito desempeñan un papel fundamental en el cálculo del GPA universitario. A cada curso se le asigna un número específico de horas crédito, que representa la cantidad de tiempo dedicado a la clase cada semana. Los cursos con más horas de crédito contribuyen de forma más significativa al GPA general.

Las notas medias de las universidades pueden variar mucho en función de la institución, los programas académicos y la población estudiantil. Aunque un promedio de "B" (alrededor de 3,0) suele considerarse satisfactorio, algunos programas o universidades competitivos pueden tener promedios de GPA más altos debido a los rigurosos estándares académicos.

Una vez abordada la cuestión de "qué es el GPA", vamos a profundizar en el procedimiento de cálculo. El proceso de cálculo del GPA sigue un enfoque sistemático que presenta ligeras variaciones en función de si se calcula para el instituto o para la universidad. A continuación, describimos los pasos para calcular el GPA en ambos contextos:

Es esencial que verifiques con tu escuela o universidad para asegurarte de que estás empleando el método exacto para el cálculo del GPA, por lo tanto, asegúrate de comprobar si tu institución utiliza un GPA ponderado o si hay algún ajuste específico en el método de cálculo.

Aparte del GPA (Grade Point Average), existen otros sistemas de calificación utilizados en la educación para evaluar el rendimiento académico de los estudiantes. Algunos de estos sistemas son:

Estos sistemas de calificación ofrecen formas alternativas de evaluar el aprendizaje de los estudiantes y pueden proporcionar una retroalimentación más significativa y personalizada para apoyar el crecimiento y el desarrollo académico. La elección del sistema de calificación puede variar en función del nivel educativo, la institución y el enfoque pedagógico específico.