days

hours

minutes

seconds

Mind The Graph Scientific Blog soll Wissenschaftlern helfen zu lernen, wie man Wissenschaft auf unkomplizierte Weise vermittelt.

Entdecken Sie ein erstaunliches Werkzeug für die Erstellung der perfekten Infografik für den Unterricht. Werten Sie Ihre Präsentationen auf und begeistern Sie Ihr Publikum mühelos.

Angesichts der raschen Verbreitung von Inhalten über verschiedene Plattformen sind Genauigkeit und Klarheit von entscheidender Bedeutung. In der heutigen informationsgesteuerten Welt spielen sowohl das Lektorat als auch das Korrektorat eine wichtige Rolle bei der Gewährleistung der Glaubwürdigkeit und Wirksamkeit schriftlicher Kommunikation. Das Lektorat verfeinert die Gesamtqualität der Inhalte und sorgt dafür, dass sie klar, kohärent und ansprechend sind - wesentliche Eigenschaften in der Fülle der Informationen. Umgekehrt dient das Korrekturlesen als letzte Absicherung, um Fehler zu vermeiden, die die Glaubwürdigkeit der Botschaft untergraben könnten. In einer Zeit, in der Informationen schnell konsumiert und weitergegeben werden, garantieren die gemeinsamen Bemühungen von Lektorat und Korrektorat nicht nur fehlerfreie Inhalte, sondern auch eine wirksame Übermittlung der beabsichtigten Botschaften, was das Vertrauen und die Verlässlichkeit beim Austausch von Sofortinformationen fördert.

Das Lektorat ist ein redaktioneller Prozess zur Verfeinerung schriftlicher Inhalte, um Klarheit, Kohärenz und die Einhaltung festgelegter Stilrichtlinien zu erreichen. Als Vermittler zwischen den Absichten des Autors und dem Verständnis des Publikums nimmt ein Lektor verschiedene Aufgaben wahr, darunter die Korrektur von Grammatik und Syntax, die Sicherstellung eines einheitlichen Stils, die Verbesserung der allgemeinen Klarheit und Kohärenz, die Überprüfung von Fakten auf Richtigkeit, die Verfeinerung der Sprache und die Anpassung von Formatierungselementen. Diese vielseitige Aufgabe trägt dazu bei, ein Manuskript in ein ausgefeiltes, fehlerfreies und professionell präsentiertes Endprodukt zu verwandeln.

Grammatik und Syntax: Korrektur von grammatikalischen Fehlern, Sicherstellung einer korrekten Satzstruktur und Beseitigung von Syntaxproblemen zur Verbesserung der Lesbarkeit.

Stilistische Konsistenz: Durchsetzung eines einheitlichen Sprachgebrauchs, einer einheitlichen Formatierung und der Einhaltung eines bestimmten Styleguides.

Klarheit und Kohärenz: Verbesserung der allgemeinen Klarheit und Kohärenz des Textes durch Neuordnung oder Umstrukturierung von Sätzen und Absätzen.

Faktenüberprüfung: Überprüfung der sachlichen Richtigkeit, der Daten und der Referenzen, um die Glaubwürdigkeit des Inhalts zu wahren.

Rechtschreibung und Zeichensetzung: Sicherstellung einer korrekten Rechtschreibung, korrekten Zeichensetzung und Einhaltung der gängigen Konventionen.

Sprache polieren: Verfeinerung der Sprache, um sie an den beabsichtigten Ton, die Zielgruppe und den Zweck des Dokuments anzupassen.

Formatierung und Layout: Überprüfung und Anpassung von Formatierungselementen, um eine visuell ansprechende und konsistente Präsentation zu schaffen.

Das Korrektorat ist die letzte und sorgfältigste Phase des redaktionellen Prozesses, die der umfassenden Überprüfung und Korrektur schriftlicher Inhalte vor der Veröffentlichung gewidmet ist. Als ultimative Qualitätskontrolle spielt der Korrekturleser eine zentrale Rolle bei der Gewährleistung von Genauigkeit und Klarheit, indem er Grammatik-, Rechtschreib- und Zeichensetzungsfehler sorgfältig korrigiert, die Konsistenz von Sprache und Formatierung aufrechterhält und Details auf sachliche Richtigkeit überprüft.

Grammatik und Rechtschreibung: Korrektur von grammatikalischen Fehlern, Identifizierung und Berichtigung von Rechtschreibfehlern und Sicherstellung der korrekten Verwendung von Interpunktion.

Konsistenz: Überprüfung und Beibehaltung der Konsistenz von Sprachgebrauch, Formatierung und Stil im gesamten Dokument.

Typografie und Formatierung: Prüfung auf typografische Fehler, Sicherstellung der einheitlichen Verwendung von Schriftarten und Überprüfung der Gesamtformatierung des Dokuments auf ein optimales Erscheinungsbild.

Genauigkeit der Referenzen: Überprüfung der Richtigkeit von Verweisen, Zitaten und anderen faktischen Elementen, um die Zuverlässigkeit des Dokuments zu gewährleisten.

Cross-Checking Details: Sorgfältige Querverweise auf Details, wie Namen, Daten und Zahlen, um Genauigkeit und Kohärenz zu gewährleisten.

Abschließende Überprüfung der Lesbarkeit: Führen Sie eine abschließende Prüfung auf allgemeine Lesbarkeit und Kohärenz durch und gehen Sie dabei auf alle noch bestehenden Probleme ein, die die Klarheit des Dokuments beeinträchtigen könnten.

Copyediting vs. Proofreading stellt zwei unterschiedliche Prozesse bei der Bearbeitung schriftlicher Inhalte gegenüber. Obwohl sowohl das Lektorat als auch das Korrektorat zur Verfeinerung schriftlicher Inhalte beitragen, unterscheiden sich ihre Hauptziele und Schwerpunktbereiche. Das Lektorat zielt darauf ab, die Gesamtqualität des Textes zu verbessern, indem es sich mit Fragen des Stils, der Organisation und des Sprachgebrauchs befasst. Das Korrekturlesen hingegen konzentriert sich speziell auf die Beseitigung von Fehlern, die in früheren Phasen übersehen wurden, wobei der Schwerpunkt auf der Korrektheit und der Einhaltung von Sprachkonventionen liegt.

Das Lektorat ist detaillierter und umfangreicher und erfordert ein umfassendes Verständnis des Kontextes, des Stils und der Zielgruppe des Dokuments. Es kann die Umstrukturierung von Sätzen, die Verbesserung von Übergängen und die Sicherstellung der Konsistenz des gesamten Textes beinhalten. Im Gegensatz dazu ist das Korrekturlesen eher detailorientiert und konzentriert sich auf das Aufspüren und Korrigieren einzelner Fehler, ohne die Gesamtstruktur oder den Stil wesentlich zu verändern. Gemeinsam tragen diese Prozesse dazu bei, dass ein ausgefeiltes, fehlerfreies und professionell präsentiertes schriftliches Material entsteht.

Original-Satz: "Die Konferenz beginnt um 14 Uhr, und die Teilnehmer werden gebeten, pünktlich zu sein.

Geänderte Version: "Die Konferenz beginnt um 14.00 Uhr, und die Teilnehmer werden dringend gebeten, pünktlich zu sein.

Erläuterung: In diesem Beispiel verbesserte der Redakteur die Klarheit durch die Angabe des Zeitformats, passte die Formulierung an und ersetzte "commence" durch das gebräuchlichere "start".

Original-Passage: "Trotz der unzähligen Herausforderungen, mit denen die Organisation konfrontiert war, ist es ihr gelungen, durchzuhalten und jedes Hindernis zu überwinden".

Geänderte Version: "Trotz der zahlreichen Herausforderungen, mit denen die Organisation konfrontiert war, haben sie durchgehalten und jedes Hindernis überwunden".

Erläuterung: Der Redakteur hat den Ausdruck vereinfacht, indem er "myriad of" durch "numerous" ersetzt hat, was den Satz prägnanter und leichter verständlich macht.

Original-Satz: "Der Bericht wurde fristgerecht eingereicht.

Korrekturgelesene Version: "Der Bericht wurde fristgerecht eingereicht.

Erläuterung: Der Korrekturleser korrigierte den Rechtschreibfehler in "Bericht" und sorgte so für die Richtigkeit der endgültigen Fassung des Dokuments.

Ursprünglicher Absatz: "Die Gewinnspanne des Unternehmens ist im letzten Quartal um 15% gestiegen."

Korrekturgelesene Version: "Die Gewinnspanne des Unternehmens stieg im letzten Quartal um 15%."

Erläuterung: Der Korrekturleser hat den Tippfehler in "Quartett" erkannt und korrigiert und durch den korrekten Begriff "Viertel" ersetzt.

Rechtschreib- und Grammatikfehler: Übliche Tipp-, Rechtschreib- und Grammatikfehler werden oft übersehen, können aber die Klarheit und Professionalität des Textes erheblich beeinträchtigen.

Ungereimtheiten im Stil: Achten Sie auf eine einheitliche Sprache, Formatierung und einen einheitlichen Stil im gesamten Dokument, insbesondere wenn es um Zahlen, Daten und Zitate geht.

Zweideutige Formulierungen: Achten Sie auf Sätze oder Ausdrücke, die für die Leser unklar oder zweideutig sein könnten. Klären Sie sie und formulieren Sie sie neu, um sie besser zu verstehen.

Redundanz und Wortkargheit: Streichen Sie unnötige Wörter und Sätze, um die Klarheit und Prägnanz des Dokuments zu verbessern.

Erstellen Sie eine Checkliste: Entwickeln Sie eine personalisierte Checkliste für die Bearbeitung, um verschiedene Elemente systematisch zu überprüfen und sicherzustellen, dass während des Bearbeitungsprozesses nichts übersehen wird.

Versionskontrolle beibehalten: Behalten Sie den Überblick über Bearbeitungen und Überarbeitungen, um zu vermeiden, dass während des Bearbeitungsprozesses neue Fehler auftreten. Führen Sie zu Referenzzwecken eine klare Versionsgeschichte.

Suchen Sie nach Feedback: Arbeiten Sie mit Gleichgesinnten oder Kollegen zusammen, um neue Perspektiven für das Dokument zu gewinnen. Externes Feedback kann wertvolle Erkenntnisse liefern und übersehene Fehler aufdecken.

Achten Sie auf die Details: Achten Sie genau auf Interpunktion, Abstände und Formatierungsdetails. Die konsequente Beachtung von Details trägt zu einem ausgefeilten Endprodukt bei.

Fachleute sind die Hüter der sprachlichen Präzision, die Dokumente akribisch verfeinern, damit sie den höchsten Standards entsprechen. Diese Fachleute leisten einen entscheidenden Beitrag zum Redaktionsprozess und tragen die Verantwortung für die Glaubwürdigkeit und Professionalität eines jeden schriftlichen Werks.

Sprachkenntnisse: Ein tiefes Verständnis von Grammatik, Syntax und Sprachkonventionen ist für ein effektives Lektorat und Korrektorat unerlässlich.

Liebe zum Detail: Akribische Detailarbeit ist entscheidend, um selbst die kleinsten Fehler und Unstimmigkeiten in Rechtschreibung, Zeichensetzung und Formatierung zu erkennen.

Kritisches Denken: Professionelle Redakteure und Korrektoren sind in der Lage, den Inhalt kritisch zu bewerten und sicherzustellen, dass er mit dem beabsichtigten Zweck und der Zielgruppe übereinstimmt.

Vertrautheit mit Style Guides: Kenntnis und Einhaltung verschiedener Stilrichtlinien (z. B., APA, MLA, Chicago) ist für die Wahrung der Einheitlichkeit des Sprachgebrauchs und der Formatierung unerlässlich.

Mind the Graph Plattform revolutioniert die wissenschaftliche Forschungslandschaft, indem sie ein dynamisches Toolkit anbietet, das die Arbeit von Wissenschaftlern rationalisieren und verbessern soll. Im Kern ermöglicht die Plattform durch die innovative Verwendung von Vorlagen eine erhebliche Zeitersparnis für Forscher. Dies beschleunigt nicht nur den Forschungsprozess, sondern gewährleistet auch eine konsistente und professionelle Präsentation der Daten. Mit Mind the Graph können Wissenschaftler die traditionellen Zwänge des zeitaufwändigen Grafikdesigns überwinden und sich mehr auf den Kern ihrer Forschung konzentrieren, was letztlich die Effizienz und Produktivität in der wissenschaftlichen Gemeinschaft fördert.

Der Notendurchschnitt (Grade Point Average, GPA) ist eine wichtige Kennzahl, die den akademischen Werdegang eines jeden Schülers maßgeblich beeinflusst. Ganz gleich, ob Sie ein High-School-Schüler sind, der sich um die Zulassung zu einem renommierten College bewirbt, oder ein College-Student, der nach Spitzenleistungen in seiner akademischen Laufbahn strebt, es ist von entscheidender Bedeutung zu verstehen, wie der GPA berechnet wird. Dabei geht es nicht nur um einfache Arithmetik, sondern auch um die Berücksichtigung verschiedener Notenskalen, Gewichtungsmethoden und Umrechnungen.

Dieser Artikel soll ein umfassender Leitfaden sein, der die Frage "Was ist der GPA eigentlich?" eingehend untersucht und beantwortet - von der grundlegenden Definition und den Berechnungsmethoden bis hin zu seiner tiefgreifenden Bedeutung in der High School und im College.

Der Notendurchschnitt (Grade Point Average, GPA) ist eine standardisierte numerische Darstellung der akademischen Gesamtleistung eines Studenten. Er wird in Bildungseinrichtungen verwendet, um die Leistungen von Studierenden mit unterschiedlichem akademischen Hintergrund zu bewerten und zu vergleichen. Der Notendurchschnitt wird auf der Grundlage der in verschiedenen Kursen erzielten Noten berechnet und ist ein quantifizierbares Maß für den Studienerfolg eines Studierenden.

In den meisten Fällen wird der GPA in den Vereinigten Staaten auf einer Skala von 0,0 bis 4,0 angegeben, wobei 4,0 der höchste erreichbare GPA ist. In anderen Ländern oder Bildungssystemen kann die Notenskala jedoch abweichen. Das GPA-System ermöglicht es Hochschulen, Universitäten und Arbeitgebern, Bewerber und Kandidaten effizienter zu bewerten, da es ihre akademischen Leistungen in einer einzigen numerischen Punktzahl zusammenfasst.

Lesen Sie auch: Bewerben an der Graduiertenschule: Ein vollständiger und anschaulicher Leitfaden

Zur Berechnung des GPA werden in der Regel Buchstabennoten (z. B. A, B, C, D) oder Prozentsätze in entsprechende Notenpunkte umgewandelt (z. B. A = 4,0, B = 3,0, C = 2,0, D = 1,0), und diese Notenpunkte werden dann über alle innerhalb eines bestimmten Zeitraums belegten Kurse gemittelt. Die sich daraus ergebende GPA-Punktzahl ist ein wesentlicher Faktor für die Zulassung zum College, für die Vergabe von Stipendien und akademischen Auszeichnungen sowie für verschiedene Möglichkeiten im akademischen und beruflichen Bereich.

Insgesamt ist der Notendurchschnitt eine wichtige Kennzahl, die die akademischen Leistungen, das Engagement und die Beständigkeit der Studierenden widerspiegelt und somit einen wichtigen Aspekt ihres Bildungswegs und ihrer Zukunftsaussichten darstellt.

Im Bildungsbereich ist der High School Grade Point Average (GPA) eines Schülers von großer Bedeutung. Er ist ein wichtiges Maß für die akademische Leistung und spielt eine entscheidende Rolle bei der Zulassung zum College, bei der Vergabe von Stipendien und beim allgemeinen akademischen Fortschritt. Das Verständnis der High School GPAs und der Faktoren, die sie beeinflussen, kann sich erheblich auf den Bildungsweg und die Zukunftsaussichten eines Schülers auswirken.

Der High School GPA ist eine numerische Darstellung der kumulativen akademischen Leistung eines Schülers während seiner High School Jahre. Er quantifiziert die Noten in allen Kursen und liefert eine Durchschnittsnote, die den gesamten schulischen Erfolg widerspiegelt. In der Regel wird der High School GPA auf einer Skala von 0,0 bis 4,0 berechnet, wobei 4,0 der höchste erreichbare GPA ist und eine perfekte Note bedeutet.

High School GPAs werden oft nach zwei primären Skalen berechnet: gewichtet und ungewichtet. Der Unterschied liegt darin, wie bestimmte Kurse extra gewichtet werden, was sich auf die Berechnung des GPA auswirkt.

Der Notendurchschnitt gibt einen aufschlussreichen Überblick über die akademischen Leistungen eines Schülers. Durch die Zusammenfassung mehrerer Noten zu einem einzigen numerischen Wert bieten sie eine schnelle Bewertung der Gesamtleistung eines Schülers. Ein höherer Notendurchschnitt deutet auf konstant gute Leistungen hin, während ein niedrigerer Notendurchschnitt auf Verbesserungsmöglichkeiten hinweist.

Mehrere Faktoren beeinflussen den High School GPA eines Schülers:

Der durchschnittliche Notendurchschnitt kann je nach Bildungseinrichtung und Schülerpopulation variieren. An vielen High Schools kann er zwischen 2,5 und 3,5 liegen, in Ausnahmefällen übersteigt er an Schulen, die gewichtete GPAs verwenden, 4,0.

Um einen perfekten Notendurchschnitt von 4,0 zu erreichen, müssen die Schüler während ihrer gesamten Highschool-Zeit in allen Kursen durchgehend Einser-Noten erhalten. Diese herausragende Leistung spiegelt das Engagement und die akademische Exzellenz eines Schülers wider und hebt ihn bei College-Bewerbungen und Stipendienüberlegungen hervor.

Mit dem Übergang zur Hochschulbildung gewinnt der Notendurchschnitt (GPA) an Bedeutung. College-GPAs sind ein wichtiger Indikator für die akademischen Leistungen eines Schülers während seiner Universitätslaufbahn. Zu verstehen, wie sich College-GPAs von Highschool-GPAs unterscheiden, und die verschiedenen Faktoren, die ihre Berechnung beeinflussen, ist für Schüler, die sich mit den Herausforderungen und Chancen der College-Erfahrung auseinandersetzen wollen, unerlässlich.

Der College-GPA ist wie sein Pendant in der High School eine numerische Darstellung der akademischen Leistungen eines Schülers. Im College kann die GPA-Skala jedoch von der traditionellen 4,0-Skala abweichen. Sie reicht in der Regel von 0,0 bis 4,0, kann aber auch zusätzliche Werte wie 4,3 oder 5,0 enthalten, insbesondere wenn gewichtete Kurse berücksichtigt werden.

Obwohl sowohl der High School GPA als auch der College GPA die akademischen Leistungen bewerten, gibt es einige wichtige Unterschiede zwischen ihnen:

Die Credit-Stunden spielen eine wichtige Rolle bei der Berechnung des College-GPA. Jedem Kurs wird eine bestimmte Anzahl von Kreditstunden zugewiesen, die den wöchentlichen Zeitaufwand für den Kurs darstellen. Kurse mit mehr Kreditstunden tragen stärker zum Gesamt-GPA bei.

Der durchschnittliche Notendurchschnitt an Colleges kann je nach Einrichtung, Studiengang und Studentenpopulation stark variieren. Während ein "B"-Durchschnitt (um die 3,0) oft als zufriedenstellend angesehen wird, können einige wettbewerbsfähige Programme oder Colleges aufgrund strenger akademischer Standards höhere durchschnittliche GPAs haben.

Nachdem wir uns mit der Frage "Was ist der GPA?" beschäftigt haben, wollen wir uns nun mit dem Berechnungsverfahren befassen. Die Berechnung des GPA folgt einem systematischen Ansatz, der sich leicht unterscheidet, je nachdem, ob Sie ihn für die High School oder das College berechnen. Im Folgenden werden die Schritte zur Berechnung des GPA in beiden Kontexten erläutert:

Es ist wichtig, sich bei Ihrer Schule oder Hochschule zu vergewissern, dass Sie die richtige Methode zur Berechnung des GPA anwenden. Prüfen Sie daher, ob Ihre Einrichtung einen gewichteten GPA verwendet oder ob es spezielle Anpassungen der Berechnungsmethode gibt.

Neben dem GPA (Notendurchschnitt) gibt es verschiedene andere Benotungssysteme, die im Bildungswesen verwendet werden, um die akademischen Leistungen der Schüler zu beurteilen und zu bewerten. Einige dieser Systeme sind:

Diese Benotungssysteme bieten alternative Möglichkeiten zur Bewertung des Lernerfolgs der Schüler und können ein aussagekräftigeres und individuelleres Feedback zur Förderung des akademischen Wachstums und der Entwicklung geben. Die Wahl des Benotungssystems kann je nach Bildungsstufe, Institution und spezifischem pädagogischen Ansatz variieren.

Transformieren Sie Ihre wissenschaftliche Kommunikation mit Mind the Graph! Erstellen Sie mit unserer umfangreichen Bildbibliothek, Vorlagen und einer intuitiven Drag-and-Drop-Benutzeroberfläche in wenigen Minuten fesselnde Infografiken und visuelle Darstellungen. Beeindrucken Sie Ihr Publikum, sparen Sie Zeit, und steigern Sie noch heute die Wirkung Ihrer Forschung! Melden Sie sich jetzt bei Mind the Graph an und nutzen Sie die Macht des Visuellen für Ihre wissenschaftliche Arbeit.

Wir alle kennen Begriffe wie "bahnbrechend", "revolutionär" und "lebensverändernd", die zur Beschreibung verschiedener wissenschaftlicher Veröffentlichungen in den Mund genommen werden. Aber wie genau messen wir das Ausmaß der Wirkung einer wissenschaftlichen Arbeit? Hier kommt der Impact-Faktor der Wissenschaft ins Spiel. Begleiten Sie mich auf dieser informativen Reise, auf der wir dieses wichtige Instrument zur Bewertung von Forschung diskutieren, analysieren und vertiefen werden.

Der Science Impact Factor (SIF) ist eine Kennzahl, die die durchschnittliche Anzahl der Zitate angibt, die ein in einer bestimmten Zeitschrift veröffentlichter Artikel innerhalb eines bestimmten Zeitraums erhält. Ursprünglich von Eugene Garfield am Institute for Scientific Information (ISI) eingeführt, hat sich dieses Messinstrument langsam in akademischen Kreisen etabliert.

Die Idee hinter SIF ist die Quantifizierung des Einflusses oder der "Wirkung" akademischer Zeitschriften in ihrem jeweiligen Fachgebiet. Im Wesentlichen handelt es sich um eine Möglichkeit, diese Zeitschriften auf der Grundlage ihrer wahrgenommenen relativen Bedeutung unter Gleichrangigen einzustufen.

Die Geschichte von SIF geht auf das Jahr 1963 zurück, als Dr. Eugene Garfield es lediglich als Hilfsmittel für Bibliothekare bei der Auswahl der wissenschaftlichen Zeitschriften, die in die Bibliothekssammlung aufgenommen werden sollten, konzipierte. Sein Nutzen ging jedoch bald über die Bibliotheken hinaus.

Die Forscher begannen, sie als Maßstab für das Prestige zu verwenden, das mit der Veröffentlichung in bestimmten Zeitschriften verbunden ist. Im Laufe der Zeit entwickelte sich die Zahl von einer bloßen Statistik zu einem Emblem wissenschaftlicher Autorität.

Trotz der wichtigen Rolle, die er heute spielt, sollte man nicht vergessen, dass er ursprünglich nicht für diesen Zweck gedacht war; daher gibt es einige Kritik an seiner Verwendung als solches - aber dazu später mehr!

In akademischen Kreisen ist eine hohe Zitierhäufigkeit ihrer Arbeit gleichbedeutend mit einem anerkennenden Nicken, das die Bedeutung ihrer Arbeit innerhalb ihres Fachgebiets unterstreicht. Folglich werden Zeitschriften mit einem höheren wissenschaftlichen Impact-Faktor aufgrund ihrer höheren Zitierhäufigkeit oft als maßgeblicher angesehen.

Darüber hinaus beeinflusst das SIF auch die Karriereaussichten von Forschern. Bei Beförderungen und Stipendien wird häufig die Publikationsleistung des Einzelnen berücksichtigt, wozu auch das Ranking der Zeitschriften gehört, in denen seine Arbeit erscheint. Folglich ist das SIF zu einem entscheidenden Teil des Puzzles der akademischen Anerkennung und des beruflichen Aufstiegs geworden.

Auch wenn es eine sichtbare Bedeutung hat, ist es kein tadelloses Maß. In den folgenden Abschnitten werden wir uns eingehender mit der Berechnung der Auswirkungen dieses Instruments, seinen verschiedenen Verwendungszwecken, seinen potenziellen Grenzen und seinen künftigen Auswirkungen auf die Wissenschaft befassen. Bleiben Sie also dran!

In diesem Abschnitt befassen wir uns mit den genauen Mechanismen der Berechnung des wissenschaftlichen Einflussfaktors. Außerdem erfahren wir, welche Überlegungen bei der Berechnung eine Rolle spielen und wie der Impact-Faktor einer Zeitschrift letztendlich ermittelt wird.

Der Impact Factor für die Wissenschaft wird durch eine unbestreitbar einfache, aber äußerst wirkungsvolle mathematische Formel bestimmt, die vor vielen Jahrzehnten entwickelt wurde, um den Einfluss einer Zeitschrift in akademischen Kreisen zu messen. Im Wesentlichen stellt er die durchschnittliche Zitierrate dar, die die in einer Zeitschrift veröffentlichten Artikel innerhalb der ersten zwei Jahre erhalten.

Das funktioniert folgendermaßen: Die Gesamtzahl der Zitierungen, die alle in den vorangegangenen zwei Jahren in einer bestimmten wissenschaftlichen Zeitschrift veröffentlichten Artikel (vor allem Forschungsarbeiten) erhalten haben, wird durch die Gesamtzahl der in diesem Jahr in diesem Zeitraum produzierten Artikel geteilt. Daraus ergibt sich der jährliche wissenschaftliche Impact-Faktor.

Wenn die Zeitschrift Z beispielsweise im vergangenen Jahr 100 Artikel veröffentlicht hat und diese in diesem Jahr 200 Mal zitiert wurden, dann beträgt ihr jährlicher Impact-Faktor 200/100, was 2,0 entspricht.

Einfach ausgedrückt:

Impact Factor = (im Jahr X erhaltene Zitate)/(im Jahr X-1 oder X-2 veröffentlichte Artikel)

Die Berechnung des Impact-Faktors für die Wissenschaft mag zwar recht einfach erscheinen, doch müssen mehrere Faktoren berücksichtigt werden:

All diese Faktoren zusammengenommen ergeben ein differenziertes Bild davon, wie viel "Einfluss" eine Zeitschrift in ihrem Bereich tatsächlich hat.

Das Bewertungsverfahren wird von Clarivate Analytics geleitet, der Organisation, die derzeit für die Berechnung und Verteilung der jährlichen wissenschaftlichen Impact-Faktoren verantwortlich ist.

Bei diesem Prozess werden Daten aus Tausenden von akademischen und medizinischen Fachzeitschriften gesammelt, was strenge Standardisierungsverfahren erfordert, um Glaubwürdigkeit und Konsistenz zu gewährleisten. Dazu gehören:

Dieses System wird nicht nur als intuitive Methode zur Bewertung des Prestiges von Zeitschriften gelobt, sondern hilft Bibliometrikern und Forschern auch beim Vergleich von Zitationsberichten und -mustern in verschiedenen Disziplinen, was zu intelligenteren Publikationsentscheidungen führt und gleichzeitig für mehr Klarheit im akademischen Bereich sorgt.

Wenn wir uns näher mit dem Thema befassen, ist es wichtig, die verschiedenen Zwecke zu verstehen, die mit dem Impact Factor für die Wissenschaft verbunden sind. Seine Bedeutung reicht von der Bewertung von Zeitschriften über die Festlegung von Entscheidungen über wissenschaftliche Veröffentlichungen bis hin zu Finanzierungsüberlegungen von Agenturen. Der beträchtliche Einfluss des Impact-Faktors von Fachzeitschriften ist aber noch nicht alles: Er spielt auch eine entscheidende Rolle bei der Festlegung der beruflichen Laufbahn von Forschern.

Im Bereich der wissenschaftlichen Zeitschriften übertrifft die Qualität den Ruhm mit eins zu null. Und hier zeigt der Begriff "Impact Factor" seine überragende Bedeutung. Dieser Wert ist ein Indikator dafür, wie oft Veröffentlichungen aus einer bestimmten Zeitschrift in den ersten zwei Jahren nach ihrer Veröffentlichung in wissenschaftlichen Zeitschriften zitiert werden. Im Wesentlichen bedeuten höhere Impact-Faktoren eine einflussreichere Rolle, die diese Zeitschriften innerhalb ihrer jeweiligen wissenschaftlichen Disziplin spielen.

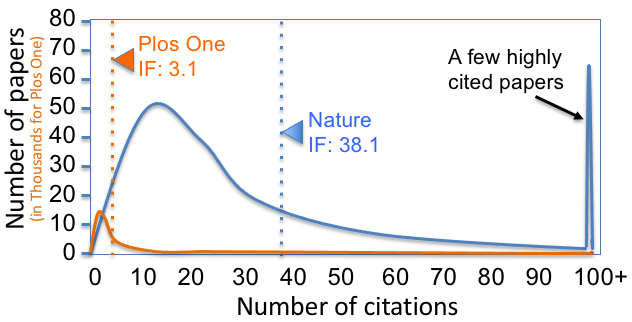

Eine in PLoS ONE veröffentlichte Studie bestätigt die oben genannten Punkte und zeigt, dass die renommiertesten wissenschaftlichen Zeitschriften einen höheren Impact-Faktor aufweisen[^1^]. Diese Erkenntnisse bestätigen, dass bei der Bewertung der Qualität von Zeitschriften ein höherer wissenschaftlicher Impact-Faktor gleichbedeutend mit besser ist.

Der Dominoeffekt setzt sich weiter fort und beeinflusst die Entscheidungen über den Ort der Forschungspublikation. Da mehr Zitate in der Regel einen höheren Nutzen und eine größere Anerkennung unter Gleichgesinnten bedeuten[^2^], entscheiden sich die Autoren häufig für Veröffentlichungen, die einen optimalen wissenschaftlichen Impact-Faktor aufweisen.

Wie wird dies erreicht? Indem sie das Interesse von Forschern wecken, die auf einen wünschenswerten Anstieg ihrer Zitationszahlen aus sind: ein wesentlicher Aspekt für die Beschleunigung des akademischen Aufstiegs und der Reputation.

Renommierte Förderorganisationen verwenden verschiedene Kennzahlen, um ihre Entscheidungsprozesse in die richtige Richtung zu lenken - und Sie haben es richtig erraten! Eine solche Kennzahl ist keine andere als unser Schwerpunkt: der wissenschaftliche Impact-Faktor.

Warum ist das so? Mehrere Studien haben gezeigt, dass ein gewisser Zusammenhang zwischen Zeitschriften mit hohem Impact-Faktor und Artikeln von hoher Qualität oder hohem Wert besteht[^3^]. Folglich ist bekannt, dass diese Fördereinrichtungen sich auf Forscher konzentrieren, deren Arbeiten häufig von Gutachtern zitiert werden, d. h. die in Zeitschriften mit hohem Impact-Faktor veröffentlicht wurden.

Ähnlicher Artikel: Bewährte Tipps zum Schreiben von Finanzhilfen: Steigern Sie Ihren Förderungserfolg

Die Vorteile, die sich aus den hohen Impact-Faktoren für die Wissenschaft ergeben, wirken sich auch auf die beruflichen Aufstiegsmöglichkeiten der Forscher aus. Die Veröffentlichung in Zeitschriften mit hohem Impact-Faktor wirkt nicht nur als Katalysator für ihr wissenschaftliches Ansehen, sondern verbessert auch die Chancen auf eine Anstellung in angesehenen Forschungseinrichtungen[^4^].

Jeder Schritt auf der Karriereleiter kann den Unterschied ausmachen, ob man eine Professur an einer Spitzenuniversität erhält oder in der akademischen Bedeutungslosigkeit verschwindet. In der Tat herrscht in der Welt der Wissenschaft ein harter Wettbewerb, und wenn Ihre Forschung durch eine höhere Anzahl von Zitaten hervorgehoben wird, kann dies in der gesamten akademischen Welt ein lautes Echo hervorrufen - dank der bemerkenswerten wissenschaftlichen Impact-Faktoren!

[^1^]: PLoS ONE: Prestige versus Einfluss [^2^]: Journal of Informetrics: Führt Quantität zu mehr Zitaten? [^3^]: BMC Medical Research Methodology: Zusammenhänge zwischen Impact-Faktor und Artikelqualität [^4^]: Nature Careers: Veröffentlichen-oder-verderben-Druck lenkt junge Forscher von innovativen Projekten ab

Der Impact-Faktor für die Wissenschaft wurde zwar entwickelt, um die Qualität und Relevanz einer wissenschaftlichen Zeitschrift zu bewerten, wird aber häufig auf der Ebene einzelner Artikel oder Forscher falsch angewandt. Kritiker argumentieren, dass der Impact Factor den Einfluss einer Person auf die Forschung aus mehreren Gründen nicht genau widerspiegelt:

Daher kann die Bewertung der Arbeit eines Wissenschaftlers auf der Grundlage des Impact-Faktors einer Zeitschrift zu einer falschen Darstellung der Bedeutung oder zur Vernachlässigung wichtiger Forschungsarbeiten führen.

Interessanterweise variiert der Wert eines wissenschaftlichen Impact-Faktors selbst von Disziplin zu Disziplin, was eine weitere Ebene der Verzerrung verursacht. Lassen Sie mich erklären, warum:

Aufgrund dieser Unterschiede ist ein disziplinübergreifender Vergleich, bei dem nur der Impact-Faktor für die Wissenschaft herangezogen wird, nahezu unpraktisch.

Kritiker bestreiten auch, dass ein direkter Zusammenhang zwischen dem Impact Factor und der Forschungsqualität besteht. Diese Frage stellt sich aufgrund von:

Beide Faktoren treiben die Zitationsraten in die Höhe und erhöhen somit den wissenschaftlichen Impact-Faktor, ohne die tatsächliche Forschungsqualität zu verbessern.

Schließlich beeinflussen bestimmte redaktionelle Maßnahmen auch den wissenschaftlichen Impact-Faktor einer Zeitschrift, was ihre Objektivität weiter in Frage stellt:

Solche berechneten Abweichungen können den tatsächlichen Wert verzerren und machen ihn zu einem weniger zuverlässigen Instrument für die Beurteilung des Eigenwerts veröffentlichter Studien.

In Anbetracht dieser Kritikpunkte möchte ich den Lesern dringend raten, die Impact-Faktoren der Wissenschaft nicht als absoluten Indikator zu betrachten. Es ist wichtig, ihre Grenzen zu erkennen und sie in Verbindung mit anderen Instrumenten zur Bewertung von Forschungsbeiträgen zu verwenden. Wir brauchen einen ganzheitlicheren Ansatz, der Aspekte wie systematische Überprüfungen, qualitative Bewertungen, gesellschaftliche Auswirkungen und altmetrische Messungen einbezieht.

In dieser komplexen Debatte um die Impact-Faktoren in der Wissenschaft sollten wir nicht vergessen, dass der Schwerpunkt immer auf der Förderung qualitativ hochwertiger, ethischer Forschung liegen sollte, unabhängig von den Metriken. Das ist in der Tat die Seele des wissenschaftlichen Fortschritts!

Der "Science Impact Factor" ist zwar ein wichtiges Instrument zur Bewertung des wissenschaftlichen Einflusses, aber nicht das einzige. In den letzten Jahren sind mehrere andere Instrumente aufgetaucht, die eine differenziertere und umfassendere Bewertung ermöglichen.

Eine weithin akzeptierte Alternative ist der h-Index, der von Jorge Hirsch entwickelt wurde. Der h-Index misst die Produktivität eines Autors und seinen Einfluss auf die Zitationen im Vergleich zu den Fachzeitschriften. Wissenschaftler mit einem h-Index von "n" haben "n" Arbeiten mit jeweils mindestens "n" Zitierungen veröffentlicht. Diese Metrik umgeht einige Einschränkungen des wissenschaftlichen Impact-Faktors, da sie sowohl die Quantität als auch die Qualität der von einem Forscher im Laufe der Zeit produzierten Arbeit berücksichtigt.

Ein weiterer Ansatz, der sich immer mehr durchsetzt, ist altmetrics - kurz für alternative Metriken. Dieses System geht über die traditionellen, auf Zitaten basierenden Metriken hinaus und erfasst die Online-Beachtung von Forschungsergebnissen auf verschiedenen digitalen Plattformen wie Referenzmanagern, sozialen Mediennetzwerken, Nachrichten, Blogs und politischen Dokumenten.

Darüber hinaus berücksichtigt der Eigenfactor® Score die gesamte wissenschaftliche Bedeutung einer Zeitschrift auf der Grundlage ihres Gesamteinflusses und nicht nur die durchschnittliche Anzahl der Zitate pro Artikel wie beim Science Impact Factor.

Wie Einstein einmal sagte: "Nicht alles, was gezählt werden kann, zählt, und nicht alles, was zählt, kann gezählt werden". Diese Alternativen zum Impact-Faktor für die Wissenschaft haben jeweils ihre Stärken, aber auch ihre Schwächen.

Die Stärke des h-Index liegt in seiner Fähigkeit, den dauerhaften Beitrag eines einzelnen Wissenschaftlers und nicht seine vorübergehende Popularität zu messen. Allerdings kann er nicht zwischen aktiven und inaktiven Wissenschaftlern unterscheiden, wenn beide eine ähnliche Publikationsgeschichte haben.

Altmetrics nutzt moderne Datenquellen für eine breitere Evaluierung, die unmittelbare gesellschaftliche Auswirkungen widerspiegelt, die von traditionellen Metriken oft ausgeschlossen werden. Die Schwäche liegt in der Anfälligkeit für Manipulationen; außerdem spiegeln diese Indikatoren für soziales Engagement nicht unbedingt die Bedeutung der Wissenschaft wider.

Eigenfactor® bietet durch seine naturabhängigen Bewertungsmodelle einen Einblick in das Zeitschriftenprestige und den mehrdimensionalen Einfluss wissenschaftlicher Veröffentlichungen, die multidisziplinär und größenneutral sind. Trotz dieser ausgefeilten Modelle bleibt Eigenfactor® jedoch anfällig für Selbstzitierpraktiken.

Daher ist kein einzelnes Maß allgemeingültig oder narrensicher. Jede Messgröße ergänzt die anderen, indem sie Aspekte berücksichtigt, die in anderen Modellen übersehen werden, und stellt ein Mosaik von Erkenntnissen über die vielschichtige Natur der wissenschaftlichen Wirkung dar. Ein breit gefächertes Instrumentarium an Messgrößen kann ein umfassenderes Bild liefern als ein einzelner Index und daran erinnern, dass gute Wissenschaft über Zahlen hinausgeht.

Angesichts der zunehmenden Kritik an der Zuverlässigkeit und Unparteilichkeit des Impact Factors in der Wissenschaft haben verschiedene Institutionen und Organisationen bemerkenswerte Anstrengungen unternommen, um seine Grenzen aufzuzeigen. So wurde in der Forschungsgemeinschaft verstärkt untersucht, ob diese Bewertung wirklich das Prestige einer Zeitschrift widerspiegelt oder nur eine Illusion ist.

Vereinfacht gesagt, wird einhellig anerkannt, dass ein übermäßiges Vertrauen in wissenschaftliche Impact-Faktoren den wissenschaftlichen Einfallsreichtum und die Qualität beeinträchtigen könnte. Besondere Erwähnung verdient hier die bahnbrechende Erklärung von San Francisco zur Forschungsbewertung (DORA), in der eine ganzheitlichere Bewertungsmethodik gefordert wird, die auch andere Faktoren als nur die Anzahl der Zitate berücksichtigt.

Darüber hinaus sind Institutionen wie der Wellcome Trust und UK Research & Innovation (UKRI) Vorreiter bei Reformen zur Bekämpfung dieser Mängel. Zu ihren Zielen gehören die Förderung des verantwortungsvollen Einsatzes von Metriken bei Finanzierungsentscheidungen und die Förderung ethischer Praktiken bei Forschern, die höhere Impact-Faktoren anstreben.

Die Kritik am Impact-Faktor für die Wissenschaft hat in allen wissenschaftlichen Bereichen weltweit zu drastischen Veränderungen in den Systemen zur Forschungsbewertung geführt. Es gibt einen zunehmenden Trend zur Einführung multidimensionaler Methoden, die eine umfassende Sicht der Forschungseffizienz über bibliometrische Maße hinaus ermöglichen sollen.

Der AI Score von Semantic Scholar ist eine solche Methode, bei der Algorithmen des maschinellen Lernens eingesetzt werden, um den Einfluss einer Arbeit unter Berücksichtigung verschiedener Schlüsselelemente wie Neuheit, Klarheit der Darstellung, wissenschaftliche Fundiertheit usw. zu bewerten.

Eine weitere überzeugende Alternative bietet die Software "Publish or Perish", die sowohl stark zitierten Arbeiten als auch solchen mit weniger Zitaten, aber dennoch aussagekräftigem Inhalt die gleiche Bedeutung beimisst. Dadurch werden unfaire Vorurteile, die bei traditionellen Methoden auftreten, beseitigt.

Darüber hinaus gehen die Organisationen dazu über, neben dem öffentlichen Engagement, der akademischen Betreuung und der Gestaltung der Politik auch den Plan des Bewerbers zur Förderung der Inklusion in der Wissenschaft durch Outreach-Programme genau unter die Lupe zu nehmen, was ihr Engagement für die Förderung des künftigen wissenschaftlichen Fortschritts unterstreicht.

Da der Impact-Faktor in der Wissenschaft weiterhin für Diskussionen sorgt, sind umfassendere und gerechtere Systeme wie diese ein Schritt in die richtige Richtung. Dieser neue Trend hat zu Verbesserungen geführt, die sicherstellen, dass der Fortschritt in der Wissenschaft von einer umfassenden Bewertung abhängt und sich nicht auf einzelne Messgrößen beschränkt. Diese Bestrebungen ebnen somit einen innovativen Weg für die Zukunft der wissenschaftlichen Forschung.

Ein wichtiger Aspekt des wissenschaftlichen Umfelds, der nicht genug betont werden kann, ist die Sicherstellung ethischer Praktiken im Umgang mit dem Impact-Faktor für die Wissenschaft. Diese kritische Kennzahl bringt eine Reihe von Herausforderungen mit sich. Dazu gehören Probleme im Zusammenhang mit dem Missbrauch des Systems, um bessere Faktoren zu erhalten, die Verzerrung von Veröffentlichungen, die sich auf die Berechnungen auswirkt, sowie Schwierigkeiten bei der Wahrung von Transparenz und Fairness im Bewertungsprozess.

Der Druck, hochwirksame Forschungsergebnisse zu veröffentlichen, kann manchmal ein gutes wissenschaftliches Verhalten überschatten. Leider hat dies zu einigen skrupellosen Praktiken geführt, die darauf abzielen, den Impact-Faktor eines durchschnittlichen Artikels in einer Zeitschrift künstlich in die Höhe zu treiben.

Eine dieser illegalen Praktiken ist das "Citation Stacking", bei dem mehrere Autoren vereinbaren, sich gegenseitig zu zitieren, um ihren gemeinsamen Impact Factor zu erhöhen. Ebenso können Redakteure dazu ermutigen oder sogar darauf bestehen, Artikel aus ihren eigenen Zeitschriften zu zitieren - eine Taktik, die als "Selbstzitierung" bekannt ist -, um die Zahlen in die Höhe zu treiben.

Diese Maßnahmen mögen zwar zunächst das Ranking einer Zeitschrift oder den Ruf eines Autors verbessern, untergraben aber letztlich die Integrität des wissenschaftlichen Publikationswesens und der Wissenschaft und führen uns weiter weg von echten Bemühungen um den Wissensfortschritt.

Unter Publikationsverzerrung versteht man die Tendenz von Forschern und Redakteuren, Ergebnisse mit eindeutigen signifikanten Befunden gegenüber Studien mit negativen oder vagen Ergebnissen zu bevorzugen.

Wenn nur "positive" Ergebnisse veröffentlicht werden, führt dies zu einer verzerrten Darstellung der Daten in den Zeitschriften, was sich erheblich auf ihre wahrgenommene Relevanz auswirkt - ein direkter Einfluss auf ihren wissenschaftlichen Einflussfaktor. Dadurch wird auch ein unrealistisches Bild der wissenschaftlichen Forschung gezeichnet, bei dem alle Versuche zu großen Durchbrüchen führen, was weit von der Realität entfernt ist. Durch die Vernachlässigung der mit Nullen gefüllten Landschaften, die wir durchqueren, bevor wir auf Goldminen stoßen, schaffen wir ein falsches Bild davon, was fortschrittliche Wissenschaft ausmacht.

Diese systematische Unterdrückung schränkt die Bemühungen um Reproduzierbarkeit ein - eine wesentliche Komponente für die Validierung wissenschaftlicher Erkenntnisse - und wirft vor allem Schatten auf zukünftige Forschungswege.

Lesen Sie auch: Voreingenommenheit bei Veröffentlichungen: Alles, was Sie wissen müssen

Transparenz und Fairness sind grundlegende Ideale, nach denen vielleicht jede wissenschaftliche Arbeit streben sollte. Wenn es jedoch um Bewertungsverfahren geht, die den Impact-Faktoren der Wissenschaft zugrunde liegen, wird es schwierig, diese zu erreichen.

Eine große Herausforderung besteht darin, eine gerechte Verteilung der Zitate zu erreichen. Nicht alle Forschungsbereiche schreiten gleich schnell voran oder haben die gleiche Anzahl von Zitaten - einige Bereiche verzeichnen rasche Fortschritte und zahlreiche Veröffentlichungen, während andere eher spezialisiert sind und weniger, aber dennoch wichtige Fortschritte erzielen.

Bestehende Metriken tragen diesen Unterschieden kaum Rechnung, wodurch bestimmte Bereiche trotz ihres Nutzens und ihrer Bedeutung an den Rand gedrängt werden könnten. Auch wenn im Laufe der Zeit einige Verbesserungen zu beobachten waren, kann ein Wechsel der Methoden auf halbem Wege leider eine eigene Form der Verzerrung hervorrufen; es ist, als würde man Äpfel mit Birnen vergleichen.

Ein weiteres Problem ist, dass der Science Impact Factor als alleiniges quantitatives Maß verwendet wird, ohne andere qualitative Faktoren zu berücksichtigen, die zur Glaubwürdigkeit und Relevanz der Forschung insgesamt beitragen - eine schlüpfrige Tendenz, die zu reduktionistischen Tendenzen führt und den tatsächlichen Wert der Arbeiten schmälert.

Die Bewältigung solcher Herausforderungen erfordert die Erforschung ausgewogener Lösungen, wie z. B. die Kombination neuer, umfassender Messgrößen mit den traditionellen, um sicherzustellen, dass wir das, worauf es ankommt, auch wirklich wertschätzen - leistungsfähige Forschung zur Förderung des gesellschaftlichen Fortschritts.

Wie so oft in der dynamischen Wissenschaftslandschaft ist auch der Impact-Faktor für die Wissenschaft Veränderungen und Anpassungen unterworfen, die sich aus den ständigen Fortschritten bei den Forschungsmethoden und der Veröffentlichungspraxis ergeben.

Der Impact-Faktor spielt traditionell eine wichtige Rolle in der Bibliometrie - dem Bereich, der sich mit der Analyse von Veröffentlichungen befasst. Er wurde mit gedruckten Veröffentlichungen als Kernstück entwickelt. Da wir heute jedoch in einem digitalisierten Zeitalter leben, ist es notwendig geworden, dieses Instrument anzupassen, um die sich verändernden Gezeiten besser zu erfassen.

Mit dem Aufkommen neuerer Disziplinen wie Data Science und Computational Biology gibt es immer mehr Überschneidungen von Fachgebieten, die sich nicht gut für die traditionelle Zuordnung zu Fachkategorien in Datenbanken eignen, die Impact-Faktoren berechnen. Dies war der Auslöser für verschiedene Initiativen, die Anpassungen für diese neuen Studienbereiche vornahmen und damit den Umfang dessen, was bei der Berechnung von Impact-Faktoren berücksichtigt wird, erweiterten. In Verbindung mit den sich ständig weiterentwickelnden digitalen Analysewerkzeugen ist dieser Trend nur ein Zeichen für unser ständiges Streben nach immer größerer Genauigkeit.

Dicht dahinter folgen die Veränderungen, die das Open-Access-Publizieren mit sich bringt - ein weiterer großer Schritt in Richtung Demokratisierung der Wissensverbreitung.

Lesen Sie auch: Was ist offene Wissenschaft und warum ist sie in der Forschung wichtig?

Als die ersten Open-Access-Zeitschriften in die wissenschaftlichen Kommunikationssysteme aufgenommen wurden, gab es aufgrund zahlreicher Faktoren wie "Pay-to-Publish"-Modelle usw. Debatten über ihre Qualität. Im Laufe der Zeit sind die Impact-Faktoren vieler Zeitschriften jedoch deutlich gestiegen, was diejenigen belohnt, die qualitativ hochwertige Forschung ohne versteckte Paywalls betreiben.

Die Zunahme von Open-Access-Publikationen hat uns dazu veranlasst, die ausschließliche Abhängigkeit von Impact-Faktoren bei der Bestimmung des Wertes einer Zeitschrift oder des Einflusses eines Artikels zu hinterfragen. Viele argumentieren, dass eine einfache Untersuchung der rohen Zitationszahlen, die von Suchmaschinen wie Google Scholar ausgegeben werden, einen ähnlichen Zweck auf transparentere Weise erfüllen könnte.

Ein Blick in die Zukunft führt schließlich zu Diskussionen über den Einsatz von künstlicher Intelligenz (KI) und maschinellem Lernen (ML). Durch den Einsatz solcher Technologien könnten wir den Prozess der Identifizierung einflussreicher Arbeiten möglicherweise umfassender automatisieren als nur durch die bloße Anzahl der Zitate - und damit die Qualität der Forschung wesentlich besser widerspiegeln.

Darüber hinaus wurden Ideen zur Entwicklung von "kontextabhängigen Wirkungsfaktoren" entwickelt, um Verzerrungen in den Gesamtergebnissen entgegenzuwirken. So könnten beispielsweise "feldgewichtete" Metriken dazu beitragen, inhärente Diskrepanzen auszugleichen, die sich aus dem unterschiedlichen öffentlichen Interesse in den verschiedenen Bereichen ergeben.

Trotz der anhaltenden Debatten über den Impact-Faktor für die Wissenschaft bleibt er also ein wichtiges Instrument, das als Indikator für wissenschaftliche Relevanz dient. Die Zukunft des Impact-Faktors liegt jedoch darin, die kommenden Fortschritte zu nutzen, um seine analytische Leistung zu verfeinern und vielleicht sogar neu zu definieren, was "Impact" innerhalb der akademischen Gemeinschaft bedeutet.

Im Rahmen dieser umfassenden Analyse sind wir tief in die Welt der Impact-Faktoren in der Wissenschaft eingetaucht. Erinnern wir uns an einige hervorstechende Punkte, die durch die Zitationsanalyse gründlich erhellt wurden. In erster Linie haben wir die Bedeutung des Impact-Faktors für die Wissenschaft und seine historische Entwicklung untersucht. Außerdem haben wir beleuchtet, wie er berechnet und bewertet wird.

Im weiteren Verlauf unseres Aufsatzes untersuchten wir mehrere wichtige Anwendungsszenarien für Impact-Faktor-Rankings in der Wissenschaft - von Publikationsentscheidungen bis hin zur Beeinflussung der Ressourcenzuweisung durch Förderstellen. Außerdem haben wir festgestellt, dass der Impact-Faktor in wissenschaftlichen Kreisen zwar eine wichtige Kennzahl ist, aber auch auf Kritik stößt und anerkanntermaßen seine Grenzen hat.

Interessanterweise gibt es alternative Modelle zur Bewertung wissenschaftlicher Beiträge, die jeweils eigene Stärken und Schwächen im Vergleich zum traditionellen wissenschaftlichen Impact-Faktor-Modell aufweisen. Die Auseinandersetzung mit diesen Kritikpunkten und Alternativen hat die Einrichtungen dazu veranlasst, umfassende Bewertungssysteme einzuführen, die besser geeignet sind, den Wert der Forschung insgesamt zu beurteilen.

Schließlich wurden auch ethische Erwägungen im Zusammenhang mit der Nutzung solcher Metriken in den Blickpunkt gerückt. Alle Vergünstigungen und Privilegien bergen das Risiko, dass das System missbraucht oder manipuliert wird. Dies wiederum führt zu einer Verzerrung der Veröffentlichungen, die sich auf die endgültige Bewertung auswirkt - ein weiterer Hinweis auf die potenziellen Grenzen, die selbst allgemein anerkannten Metriken wie dem Impact-Faktor der Wissenschaft innewohnen.

Wenn wir in die Zukunft wissenschaftlicher Forschungsbewertungsmethoden wie dem Science Impact Factor (SIF) blicken, ist eines sicher: Veränderungen sind unvermeidlich. Trotz gelegentlicher Kritik ist der SIF nach wie vor ein fester Bestandteil der akademischen Bewertungssysteme in verschiedenen Disziplinen weltweit.

Es ist jedoch klar, dass moderne Trends uns dazu zwingen, ganzheitlichere Ansätze für die Beurteilung wissenschaftlicher Beiträge zu verfolgen, die über die Anzahl der Zitate oder das Prestige von Zeitschriften hinausgehen. Dieser Wandel wird nicht über Nacht geschehen, sondern erfordert nachhaltige Anstrengungen von Akademikern, Verlegern und Bewilligungsstellen gleichermaßen.

Das Aufkommen des Open-Access-Publizierens stellt die traditionellen Formen der Wissensverbreitung in Frage und zwingt uns, die Erfolgsmaßstäbe neu zu definieren, einschließlich derjenigen, die mit dem wissenschaftlichen Impact-Faktor verbunden sind. Hier können wir Möglichkeiten für potenzielle Fortschritte bei der Messung und Bewertung von Impact-Faktoren für wissenschaftliche Zeitschriften finden.

Schließlich schlagen die aufkeimenden Fortschritte in der Big-Data-Analytik und im maschinellen Lernen vor, die Art und Weise, wie wir den Wert der Wissenschaft bewerten, zu überdenken - und damit möglicherweise eine neue Ära der Forschungsbewertung einzuläuten, die deutlich nuancierter und aufschlussreicher ist. Nur die Zeit wird zeigen, welche Früchte diese Veränderungen tragen werden.

Doch bis dahin bleibt das derzeitige System mit dem Impact-Faktor als Kernstück zwar fehlerhaft, aber immer noch unser bestes Mittel, um akademische Verdienste zu quantifizieren und Entscheidungen über die Zuteilung von Ressourcen in unserem gemeinsamen Streben nach Wissenserweiterung zu treffen. Seien Sie versichert, dass der laufende Dialog innerhalb der Wissenschaft uns unaufhörlich zu einem verbesserten Schema drängt, das den Beitrag eines Forschers zu seinem Fachgebiet wirklich widerspiegelt.

Wussten Sie, dass Sie die Wirkung und den Bekanntheitsgrad Ihrer Dokumente durch erstklassige Infografiken steigern können? Es ist wahr! Mit den innovativen Mind the Graph Infografik-Tool können Sie Ihrer Forschungsarbeit eine ganz neue Dimension des Engagements verleihen. Integrieren Sie nahtlos fesselnde Grafiken, die nicht nur die Präsentation Ihrer Arbeit verstärken, sondern auch deren Reichweite auf ein größeres Publikum ausdehnen. Sind Sie bereit, Ihre akademische Kommunikation zu revolutionieren? Dann melden Sie sich noch heute an, um das volle Potenzial dieses bahnbrechenden Tools auszuschöpfen!

Eine Studie, die nach einem Gespräch zwischen zwei Wissenschaftlern im Jahr 1977 entwickelt wurde, rüttelte die gesamte Wahrnehmung von "Motivation" auf. Entwickelt von Richard Ryan und Edward Decieine Theorie namens "Selbstbestimmungstheorie (SDT)" ist ein Meilenstein im Verständnis, warum Menschen tun, was sie tun wollen. Ich wette, Sie wollen die logischen Gründe und die Wissenschaft hinter der großen Begeisterung für einige Aufgaben und der geringen Motivation für die anderen kennenlernen!

Die Selbstbestimmungstheorie öffnete die Tür zu zahlreichen psychologischen Experimenten, die der Erforschung dienten. Sie half den Wissenschaftlern zu verstehen, dass ein zweijähriges Kind zum Spielen motiviert ist und dafür keine Motivation benötigt, im Gegensatz zu einigen Aufgaben im Büro, bei denen wir uns nicht verbunden fühlen! (z. B. Büroarbeiten für einen Forscher im Vergleich zur Durchführung einer Gelelektrophorese nach einem PCR-Experiment). Die Selbstbestimmungstheorie kann, wenn sie richtig verstanden wird, Fachleuten wie Lehrern, Professoren, Wissenschaftlern und aus familiärer Sicht Eltern dabei helfen, motivierte Umgebungen für Schüler, Angestellte und Kinder zu schaffen und die Lernergebnisse und das Wohlbefinden zu verbessern.

Ist es Ihnen schon einmal schwergefallen, Worte dafür zu finden, was Sie motiviert hat, bei einer Präsentation/einem Projekt/einem Wettbewerb usw. gut abzuschneiden? Manchmal sagen wir, dass wir für eine bestimmte Aufgabe weniger motiviert oder hoch motiviert sind, und wir wissen nicht, was Motivation ist. Eine einfache Erklärung: Motivation ist Energie zum Handeln. Motivation lässt sich nicht in Einheiten wie kg, km, Pascal oder Joule quantifizieren, aber wenn Sie genug nachdenken, werden Sie zustimmen, dass Motivation die psychologische Energie ist, die das Handeln antreibt. Die Selbstbestimmungstheorie erlaubt es uns, tiefer in das Konzept einzutauchen, und beschreibt die Art der Motivation und die Wissenschaft hinter dem Gefühl der "Amotivation".

Der Kernbestandteil der Selbstbestimmungstheorie ist die Unterscheidung zwischen extrinsischer und intrinsischer Motivation. Die Theorie dreht sich um die Art der Motivation und ihre Ergebnisse. Extrinsische Motivation wird auch als kontrollierte Motivation bezeichnet. Lassen Sie uns tiefer eintauchen und sie besser verstehen.

Extrinsische Motivation bezieht sich auf die Verfolgung von Zielen oder das Engagement in Aktivitäten, die in erster Linie durch externe Belohnungen oder Konsequenzen angetrieben werden und nicht durch die Freude oder Befriedigung, die sich aus der Aufgabe selbst ergibt. Extrinsisch motivierte Personen können sich an Aktivitäten beteiligen, um greifbare Belohnungen wie Geld, Lob oder soziale Anerkennung zu erhalten oder um Bestrafungen oder negative Ergebnisse zu vermeiden.

Ein Schüler könnte zum Beispiel fleißig für eine bevorstehende Prüfung lernen, nicht weil er das Thema an sich interessant oder angenehm findet, sondern um eine gute Note zu erzielen und von seinen Eltern oder Lehrern gelobt zu werden. Bei extrinsisch motiviertem Verhalten liegt der Schwerpunkt auf dem externen Ergebnis oder Anreiz und nicht auf der inhärenten Freude oder Befriedigung, die sich aus der Tätigkeit ergibt.

Oder stellen Sie sich am Arbeitsplatz vor, dass ein Mitarbeiter Überstunden für ein Projekt macht, nicht weil er die Arbeit besonders spannend oder sinnvoll findet, sondern weil er durch die Überstundenvergütung zusätzliches Geld verdienen möchte. Obwohl er sich müde oder wenig begeistert von der Aufgabe fühlt, ist der Mitarbeiter motiviert, Überstunden zu machen, und zwar ausschließlich wegen der externen Belohnung durch eine höhere finanzielle Vergütung. In diesem Szenario ist die extrinsische Motivation, die das Verhalten des Mitarbeiters antreibt, der Wunsch, mehr Geld zu verdienen, und nicht die intrinsische Freude oder Erfüllung, die sich aus der Arbeit selbst ergibt.

Intrinsische Motivation bedeutet, dass eine Tätigkeit oder ein Ziel aufgrund der ihr innewohnenden Befriedigung, des Vergnügens oder der persönlichen Erfüllung ausgeübt wird und nicht aufgrund externer Belohnungen oder Zwänge. Personen, die intrinsisch motiviert sind, werden durch ein echtes Interesse an der Tätigkeit selbst angetrieben, da sie diese als angenehm, herausfordernd oder persönlich bedeutsam empfinden. Eine Person, die gerne Klavier spielt, übt beispielsweise stundenlang aus reiner Freude an der Musik und dem persönlichen Erfolgserlebnis, das sie dabei empfindet, ohne äußeren Druck oder die Erwartung einer Belohnung.

Intrinsische Motivation zeichnet sich durch ein Gefühl der Autonomie, Kompetenz und Verbundenheit aus, da der Einzelne ein Gefühl der Eigenverantwortung und Kontrolle über seine Handlungen hat, sich selbst als fähig ansieht, die Aufgabe zu meistern, und möglicherweise ein tiefes Gefühl der Verbundenheit oder des Engagements mit der Tätigkeit oder dem Ziel empfindet.

Stellen Sie sich einen Wissenschaftler vor, dem das Verständnis der komplexen Zusammenhänge des Klimawandels am Herzen liegt. Angetrieben von echter Neugier und dem Wunsch, zum kollektiven Verständnis dieses kritischen Themas beizutragen, widmet der Wissenschaftler unzählige Stunden der Forschung, der Analyse von Daten und der Formulierung von Hypothesen. Trotz der Herausforderungen und Unwägbarkeiten, die mit der wissenschaftlichen Forschung verbunden sind, findet der Forscher im Prozess der Entdeckung selbst eine innere Befriedigung und Erfüllung. Die Freude darüber, neue Erkenntnisse zu gewinnen, Muster aufzudecken und das Wissen auf ihrem Gebiet voranzubringen, ist ein starker intrinsischer Motivator, der das Engagement und die Ausdauer des Wissenschaftlers in seinen Forschungsbemühungen antreibt. In diesem Fall entspringt die intrinsische Motivation des Forschers eher dem ihm innewohnenden Interesse und der Leidenschaft für das Thema als äußeren Belohnungen oder Zwängen.

Im Rahmen der Selbstbestimmungstheorie (SDT) sind Autonomie, Kompetenz und Verbundenheit drei grundlegende psychologische Bedürfnisse, die für die Förderung von intrinsischer Motivation, Wohlbefinden und optimalem Funktionieren unerlässlich sind.

Autonomie bezieht sich auf das Gefühl des Willens, der Wahl und der Selbstbestätigung bei den eigenen Handlungen. Sie beinhaltet das Gefühl, dass das eigene Verhalten selbstbestimmt ist und mit den eigenen Werten, Interessen und Zielen übereinstimmt, anstatt durch externen Druck oder Anforderungen kontrolliert zu werden. Im Kontext der SDT fördern autonomieunterstützende Umgebungen das Autonomiegefühl des Einzelnen, indem sie Möglichkeiten zum Selbstausdruck, zur Entscheidungsfindung und zur unabhängigen Problemlösung bieten. Wenn sich der Einzelne autonom fühlt, hat er ein stärkeres Gefühl der Eigenverantwortung und des Engagements bei seinen Aktivitäten, was zu einer höheren Motivation, Zufriedenheit und einem größeren Wohlbefinden führt.

Kompetenz bezieht sich auf das Gefühl von Effektivität, Beherrschung und Fähigkeit in der Interaktion mit der Umwelt. Dazu gehört das Vertrauen in die eigene Fähigkeit, Herausforderungen erfolgreich zu bewältigen, neue Fähigkeiten zu erlernen und Aufgaben zu erfüllen. Im Rahmen der SDT bieten kompetenzfördernde Umgebungen dem Einzelnen die Möglichkeit, seine Fähigkeiten zu entwickeln und unter Beweis zu stellen, konstruktives Feedback zu erhalten und ein Gefühl von Fortschritt und Wachstum zu erleben. Wenn Menschen sich selbst als kompetent wahrnehmen, fühlen sie sich eher motiviert, zuversichtlich und intrinsisch zufrieden in ihrem Streben, was zu größerer Ausdauer und Leistung führt.

Verbundenheit bezieht sich auf das Gefühl von Verbundenheit, Zugehörigkeit und zwischenmenschlichem Engagement mit anderen. Dazu gehört, dass man sich in sozialen Beziehungen und Gemeinschaften verstanden, umsorgt und wertgeschätzt fühlt. Im Kontext der SDT fördert ein die Verbundenheit unterstützendes Umfeld positive soziale Interaktionen, Einfühlungsvermögen und gegenseitigen Respekt, wodurch das Gefühl der Verbundenheit und Zugehörigkeit des Einzelnen gefördert wird. Wenn der Einzelne ein Gefühl der Verbundenheit erfährt, ist es wahrscheinlicher, dass er sich motiviert, unterstützt und emotional erfüllt fühlt, was zu mehr Wohlbefinden und Wohlstand führt.

Neben Deci und Ryan haben auch mehrere andere Wissenschaftler wesentlich zur Entwicklung und Erweiterung der Selbstbestimmungstheorie (SDT) beigetragen. Einige prominente Forscher sind:

Diese und andere Forscher haben unser Verständnis von SDT vertieft, ihre Anwendung auf verschiedene Disziplinen ausgeweitet und ihre theoretischen Konstrukte durch empirische Forschung und praktische Anwendungen verfeinert.

Im Bildungsbereich lassen sich die Grundsätze der SDT auf die Gestaltung von Lernumgebungen anwenden, die die Autonomie, Kompetenz und Verbundenheit der Schüler fördern und so ihre Motivation und akademischen Leistungen verbessern. Lehrer können beispielsweise die Autonomie fördern, indem sie den Schülern Wahlmöglichkeiten und Gelegenheiten zum selbstgesteuerten Lernen bieten, indem sie ihnen beispielsweise erlauben, Themen für Projekte auszuwählen, oder indem sie verschiedene Lernwege anbieten, um unterschiedlichen Lernstilen gerecht zu werden. Durch die Förderung von Kompetenzen können Lehrer konstruktives Feedback, Unterstützung und herausfordernde Aufgaben anbieten, die den Fähigkeiten der Schüler entsprechen und ihnen helfen, ein Gefühl der Beherrschung und Vertrauen in ihre Fähigkeiten zu entwickeln. Zur Förderung der Verbundenheit gehört auch die Schaffung eines unterstützenden Klassenklimas, das durch positive Lehrer-Schüler-Beziehungen, die Zusammenarbeit mit Gleichaltrigen und ein Gefühl der Zugehörigkeit gekennzeichnet ist. So können beispielsweise Gruppenprojekte, die die Zusammenarbeit und soziale Interaktion fördern, das Gefühl der Verbundenheit und das Engagement der Schüler beim Lernen unterstützen.

Auch am Arbeitsplatz können die Grundsätze der SDT angewandt werden, um ein motivierendes Umfeld zu schaffen, das die Arbeitszufriedenheit, die Leistung und das Wohlbefinden der Mitarbeiter steigert. Unternehmen können Autonomie fördern, indem sie ihren Mitarbeitern Autonomie bei der Entscheidungsfindung, der Aufgabenzuteilung und den Arbeitsplänen gewähren und sie so in die Lage versetzen, ihre Arbeit selbst in die Hand zu nehmen und sie mit ihren persönlichen Werten und Zielen in Einklang zu bringen. Die Förderung von Kompetenz beinhaltet das Angebot von Schulungen, Ressourcen und Möglichkeiten zur Entwicklung von Fähigkeiten und Wachstum, damit die Mitarbeiter neue Fähigkeiten erwerben, Herausforderungen bewältigen und sinnvolle Fortschritte in ihrer Karriere erzielen können. Zur Förderung der Verbundenheit gehört auch die Förderung einer positiven Arbeitskultur, die durch unterstützende Beziehungen, offene Kommunikation und ein Gefühl der Zugehörigkeit unter den Kollegen gekennzeichnet ist. So können beispielsweise teambildende Maßnahmen, Mentoring-Programme und Anerkennungsinitiativen ein Gefühl der Kameradschaft und der gegenseitigen Unterstützung fördern und so das Engagement und den Einsatz der Mitarbeiter für ihre Arbeit erhöhen.

Sie können die Forschungsergebnisse im Detail nachlesen: "Die Geschichte der Selbstbestimmungstheorie in Psychologie und Management“.

Die Selbstbestimmungstheorie (Self-Determination Theory, SDT) hat einen großen Einfluss auf das Verständnis menschlicher Motivation und menschlichen Verhaltens, weist aber auch einige Einschränkungen auf, die es zu beachten gilt:

Die SDT wurde in erster Linie in westlichen kulturellen Kontexten entwickelt, was ihre Verallgemeinerbarkeit auf verschiedene kulturelle Umgebungen einschränken kann. Die Betonung der Theorie auf individueller Autonomie und Unabhängigkeit kann die kulturellen Nuancen und Unterschiede in der Motivation in verschiedenen Kulturkreisen nicht vollständig erfassen. Daher kann die Anwendbarkeit und Relevanz der SDT in nicht-westlichen Kulturen begrenzt sein, was eine vorsichtige Interpretation und Anwendung in verschiedenen kulturellen Kontexten erfordert.

Die SDT konzentriert sich auf intrinsische und extrinsische Motivation als unterschiedliche Konstrukte, aber in Wirklichkeit ist Motivation oft vielschichtig und komplex. Individuen können eine Mischung aus intrinsischen und extrinsischen Motiven erleben, die auf dynamische Weise interagieren, was es schwierig macht, Motivationen in diskrete Kategorien zu kategorisieren. Außerdem werden bei der SDT möglicherweise andere wichtige Faktoren übersehen, die die Motivation beeinflussen, wie Persönlichkeitsmerkmale, soziale Normen und situative Faktoren, die ebenfalls eine wichtige Rolle bei der Gestaltung des Verhaltens spielen können.

Die Bewertung der Konstrukte Autonomie, Kompetenz und Verbundenheit kann eine Herausforderung darstellen, insbesondere im Hinblick auf die Entwicklung zuverlässiger und gültiger Messgrößen. Es gibt zwar verschiedene Skalen zur Messung dieser Konstrukte, aber sie erfassen möglicherweise nicht vollständig die Feinheiten der individuellen Erfahrungen oder die kontextspezifische Natur der Motivation. Darüber hinaus können die in der SDT-Forschung verwendeten Selbsteinschätzungen anfällig für Verzerrungen und soziale Erwünschtheitseffekte sein, was sich möglicherweise auf die Gültigkeit der Ergebnisse auswirkt.

Während Autonomie ein zentraler Grundsatz der SDT ist, kann eine übermäßige Konzentration auf Autonomie die Bedeutung anderer psychologischer Bedürfnisse und sozialer Einflüsse bei der Gestaltung von Motivation und Verhalten übersehen. So kann die Theorie beispielsweise die Rolle sozialer Beziehungen und Zugehörigkeit bei der Motivation von Menschen unterschätzen, insbesondere in kollektivistischen Kulturen, in denen soziale Beziehungen einen hohen Stellenwert haben.

Die SDT bietet zwar einen wertvollen theoretischen Rahmen für das Verständnis von Motivation, aber nur begrenzte praktische Anhaltspunkte für die wirksame Anwendung ihrer Prinzipien in realen Situationen. Die Umsetzung der SDT in umsetzbare Strategien zur Förderung der Motivation im Bildungs-, Gesundheits- oder Arbeitskontext kann zusätzliche Forschung und praktische Erkenntnisse erfordern, um spezifische Herausforderungen und Kontexte anzugehen.

Wir haben Motivation in jedem Klick mit Mind the Graph. Unsere Plattform bietet Ihnen die Möglichkeit, Diagramme, Infografiken, Poster und grafische Zusammenfassungen mit Icons Ihrer Wahl zu erstellen. Wählen Sie aus Tausenden von Icons und finden Sie den Bezug zu Ihren Forschungsthemen. Wir sind sicher, dass Sie Ihre Forschungsergebnisse besser vermitteln können, wenn Sie ein Gefühl der Kompetenz entwickeln. Fühlen Sie sich frei, sich mit uns in Verbindung zu setzen und die Plattform für Ihre erste Kreation zu nutzen und Ihr Wohlbefinden zu gewinnen.

Wir laden Sie ein, sich auf ein Abenteuer einzulassen, bei dem Präzision und Exzellenz zusammenkommen, um die Landschaft des wissenschaftlichen Erfolgs neu zu definieren. In der komplexen Welt der Forschung wird die Wirkung nicht nur durch die Entdeckung, sondern auch durch die Präsentation bestimmt. In diesem Blog werden wir die transformative Kraft des wissenschaftlichen Lektorats durch Experten erkunden, bei dem jedes Wort dazu beiträgt, das Bild Ihrer Forschung zu verfeinern. Unser Ziel ist es, Sie zu einem geschickten Handwerker der Klarheit, einem Architekten der Präzision zu machen. Lernen Sie, wie Sie die Wirkung Ihrer Forschung steigern können, indem Sie die Nuancen herausarbeiten, die das Gewöhnliche vom Außergewöhnlichen unterscheiden. Verlassen Sie sich auf die Kraft der Präzision und sichern Sie sich so einen beispiellosen Erfolg auf Ihrem wissenschaftlichen Weg.

Beim wissenschaftlichen Lektorat wird der schriftliche Inhalt verfeinert und verbessert, um Klarheit, Kohärenz und Präzision zu gewährleisten. Dabei geht es nicht nur um das Korrekturlesen, sondern um die Substanz und Struktur des Manuskripts. Grammatik, Syntax und Sprachgebrauch werden von erfahrenen wissenschaftlichen Redakteuren geprüft, um die Gesamtqualität der Forschungsarbeit zu verbessern. Eine nahtlose Erzählung, die den Leser in ihren Bann zieht, wird ebenfalls durch ihre Aufmerksamkeit für den logischen Fluss gewährleistet.

Neben der sprachlichen Verfeinerung prüft das wissenschaftliche Lektorat auch den wissenschaftlichen Wert, die Kohärenz und die Einhaltung von Publikationsstandards. Forscher und Redakteure arbeiten gemeinsam an der Verfeinerung ihrer Arbeit und geben Hinweise darauf, wie die Wirkung und Zugänglichkeit verbessert werden kann. Letztlich geht es beim wissenschaftlichen Lektorat darum, rohe Forschungsergebnisse in ausgefeilte Erzählungen umzuwandeln, die eine breitere Wirkung innerhalb der akademischen Gemeinschaft und darüber hinaus haben können.

Das Lektorat wissenschaftlicher Arbeiten geht über das bloße Korrekturlesen hinaus und zielt darauf ab, ihre Klarheit, Qualität und Wirkung zu verbessern. Unter Berücksichtigung von Sprache, Struktur und Kohärenz beginnt die Reise mit einer umfassenden Überprüfung des Manuskripts.

1. Bewertung und Planung: Überprüfen Sie das Manuskript gründlich und ermitteln Sie Bereiche, die in Bezug auf Sprache, Struktur und Inhalt verbessert werden können. Ermitteln Sie den Bearbeitungsprozess und entwickeln Sie einen Plan.

2. Linguistische Präzision: Verfeinerung der Sprache des Manuskripts. Verbessern Sie die Klarheit komplexer wissenschaftlicher Konzepte, indem Sie Grammatik und Syntax korrigieren und die Klarheit verbessern.

3. Strukturelle Aufwertung: Analysieren Sie den Gedankenfluss und die Gliederung des Textes. Sorgen Sie für einen reibungslosen Ablauf der Argumentation und die Einhaltung der Zitierweise, indem Sie die Struktur so umgestalten, dass sie logisch zusammenhängend ist.

4. Verfeinerung des Inhalts: Stellen Sie sicher, dass die Daten, die Methodik und die Ergebnisse genau, konsistent und zuverlässig sind. Tabellen und Abbildungen sollten so aufbereitet sein, dass sie einen sinnvollen Beitrag zum Bericht und zur Gesamtwirkung leisten.

5. Zusammenarbeit, Überprüfung und Fertigstellung: Kommunizieren Sie mit dem Autor, beantworten Sie Fragen und machen Sie Vorschläge. Sicherstellen, dass alle Elemente harmonisch aufeinander abgestimmt sind, indem eine ganzheitliche Überprüfung durchgeführt wird. Stellen Sie sicher, dass das Manuskript präzise und wissenschaftlich aussagekräftig ist, indem Sie Feedback geben, es bei Bedarf überarbeiten und abschließen.

Der Nutzen des wissenschaftlichen Lektorats geht über die bloße Fehlerkorrektur hinaus und erhöht die Qualität und Wirkung der Forschung. Zunächst einmal erhöht die sprachliche Verfeinerung die Klarheit des Manuskripts und macht komplexe wissenschaftliche Konzepte für ein breiteres Publikum zugänglich. Es verbessert nicht nur die Lesbarkeit der Arbeit, sondern erhöht auch ihre Professionalität.

Die Erzählung wird durch strukturelle Verbesserungen kohärenter und logischer. Der Redaktionsprozess gewährleistet einen klaren und überzeugenden Ideenfluss. Darüber hinaus wird eine ansprechende und überzeugende Recherche durch diese Methode unterstützt. Die wichtigsten Vorteile sind:

Die wissenschaftliche Bearbeitung geht über die Oberfläche hinaus, indem sie tiefer in den Inhalt eindringt. Daten, Methodik und Ergebnisse werden von den Redakteuren sorgfältig analysiert, um Genauigkeit und Konsistenz zu gewährleisten. Die Forschung wird durch diese Prüfung gestärkt. Ein kollaborativer Redaktionsprozess fördert auch den wertvollen Austausch zwischen Redakteuren und Autoren. Interaktionen wie diese klären nicht nur Unklarheiten, sondern stellen auch sicher, dass die Verbesserungen des Herausgebers mit der Absicht des Autors übereinstimmen und seine einzigartige Stimme bewahren.

Letztlich kommt das wissenschaftliche Lektorat der gesamten Wissenschaftsgemeinschaft zugute. Durch den Feinschliff eines Manuskripts wird sichergestellt, dass es nicht nur schnell veröffentlicht wird, sondern auch die Fachwelt beeinflusst und zum Wissensfortschritt in seinem jeweiligen Bereich beiträgt.

Die verschiedenen Arten des wissenschaftlichen Lektorats decken unterschiedliche Aspekte der Manuskriptverbesserung ab und bieten eine Reihe von Dienstleistungen, die auf die spezifischen Bedürfnisse der Autoren zugeschnitten sind. Im Folgenden werden einige Arten des wissenschaftlichen Lektorats vorgestellt:

Es werden Korrekturen an Grammatik, Syntax, Zeichensetzung und Stil vorgenommen. Dadurch wird nicht nur sichergestellt, dass die Sprache klar und einheitlich ist, sondern auch, dass der gewählte Leitfaden eingehalten wird.

Analysiert das Manuskript im Detail und geht dabei auf Fragen wie Struktur, Organisation und Fluss des Inhalts ein. Ziel ist es, die Erzählung kohärenter und klarer zu gestalten.

Prüft den Inhalt des Manuskripts, einschließlich der Richtigkeit der Daten, der Methodik und der Ergebnisse. Ein strenger, logischer und abgestimmter Redaktionsprozess stellt sicher, dass der Inhalt mit den Forschungszielen übereinstimmt.

Überprüfen Sie Grammatik, Rechtschreibung und Formatierung auf Fehler. Um alle verbleibenden Probleme vor der Veröffentlichung zu beseitigen, erfolgt das Korrekturlesen in der Regel nach einer umfangreichen Bearbeitung.

Eine maßgeschneiderte Lösung zur Erfüllung der spezifischen Anforderungen einer Zeitschrift. Mit dieser Art der Bearbeitung soll sichergestellt werden, dass das Manuskript mit der Formatierung, dem Zitierstil und anderen redaktionellen Anforderungen der Zeitschrift übereinstimmt.

Dieser Service ist speziell für Autoren gedacht, deren Muttersprache nicht Englisch ist. Er verbessert die Kohärenz und den Sprachfluss des Manuskripts, ohne die vom Autor beabsichtigte Bedeutung zu verändern.

Diese Art der Bearbeitung wird in der Regel bei technischen oder wissenschaftlichen Dokumenten angewandt und stellt sicher, dass Fachbegriffe, Jargon und komplexe Konzepte korrekt und klar sind. Die Genauigkeit der wissenschaftlichen Kommunikation hängt von ihr ab.

Konzentriert sich auf die Wahrung der Konsistenz und die Einhaltung bestimmter Schreibstile. Auf diese Weise sind Formatierung, Zitate und andere stilistische Elemente im gesamten Dokument einheitlich.

Dazu gehört die korrekte Formatierung von Überschriften, Zwischenüberschriften, Zitaten und Tabellen sowie deren Anordnung in einem geeigneten Format.

Stellt sicher, dass die Referenzen korrekt und vollständig sind. Alle Zitate werden von Redakteuren überprüft, um sicherzustellen, dass sie korrekt sind, ordnungsgemäß formatiert sind und zu den richtigen Quellen führen.

Ähnlicher Artikel: Zitieren vs. Referenzieren: Die Hauptunterschiede verstehen

Um die Qualität und Wirksamkeit Ihres Manuskripts zu gewährleisten, müssen Sie den richtigen Lektoratsdienst auswählen. Berücksichtigen Sie bei der Auswahl die folgenden Schlüsselfaktoren:

Vergewissern Sie sich, dass der Lektoratsservice Erfahrung mit der Bearbeitung Ihres spezifischen akademischen oder wissenschaftlichen Fachgebiets hat. Diejenigen, die sich mit Ihrem Fachgebiet auskennen, können Einblicke und Verbesserungen anbieten, die den Konventionen und Feinheiten Ihrer Disziplin entsprechen.

Vergewissern Sie sich, dass die mit dem Dienst verbundenen Redakteure qualifiziert und erfahren sind. Idealerweise sollten Sie sich an Personen wenden, die über einen Hochschulabschluss und Forschungserfahrung verfügen und in der Vergangenheit bereits erfolgreich wissenschaftliche Publikationen redigiert haben. Die Effizienz des Redaktionsprozesses kann durch einen qualifizierten Redakteur erheblich gesteigert werden.

Ihr Manuskript sollte von einem Dienst bearbeitet werden, der eine Vielzahl von Bearbeitungsoptionen anbietet. Vergewissern Sie sich, dass die Dienstleistung den Anforderungen Ihres Manuskripts entspricht, sei es Korrekturlesen oder inhaltliche Bearbeitung.

Stellen Sie sicher, dass die Preise und Bearbeitungszeiten Ihres Redaktionsdienstes transparent sind. Ein effizienter Zeitplan für das Lektorat und Klarheit über die Kosten sind unerlässlich. So stellen Sie sicher, dass die Dienstleistung nicht nur mit Ihrem Budget, sondern auch mit dem Abgabetermin Ihres Manuskripts vereinbar ist.

Achten Sie darauf, dass Ihr Lektoratsservice Wert auf effektive Kommunikation und Zusammenarbeit legt. Um einen kooperativen Redaktionsprozess zu gewährleisten, muss der Lektoratsservice mit Ihnen in einen offenen Dialog treten, Ihre Recherchen klären und Ihre Ziele verstehen. Ein kommunikationsorientierter Ansatz trägt zur Erstellung eines authentischen, reflektierten Manuskripts bei.

Abschließend haben wir uns mit Präzision, Zusammenarbeit und Exzellenz in der Welt der wissenschaftlichen Redaktion beschäftigt. Jeder Schritt trägt dazu bei, die Wirkung der Forschung zu erhöhen, von der sprachlichen Finesse bis zur strukturellen Kohärenz. Die Kunst des Redigierens geht weit über die Korrektur hinaus - es ist ein gemeinschaftlicher Prozess, der die Stimme des Forschers verfeinert und verstärkt. Wir haben die verschiedenen Arten von wissenschaftlichen Redaktionsdiensten und die Faktoren, die bei der Auswahl des richtigen Dienstes zu berücksichtigen sind, aufgedeckt.

Gut redigierte Manuskripte sind in der sich ständig weiterentwickelnden Welt der Wissenschaft, in der Ideen eine Währung sind, ein aussagekräftiges Zeugnis des Qualitätsbewusstseins. Mit den Erkenntnissen aus dieser Untersuchung können Sie das wissenschaftliche Lektorat nutzen, um Ihre Forschung nachhaltig zu beeinflussen, wenn Sie sich auf den Weg zu Ihrer wissenschaftlichen Arbeit machen.

Mögen Ihre wissenschaftlichen Arbeiten mit Präzision ausgeführt und Ihre Manuskripte mit der Klarheit und Professionalität redigiert werden, die sie wirklich verdienen. Ganz gleich, ob Sie ein erfahrener Forscher oder ein angehender Akademiker sind, ein wissenschaftliches Lektorat kann Ihnen dabei helfen, zeitlose Erzählungen zu verfassen. Viel Spaß beim Schreiben!

Rationalisieren Sie die Komplexität von Forschungsarbeiten und Dissertationen mit dieser neuen Lösung für die Wissenschaft. Mit Mind the Graphkönnen Sie visuelle Elemente nahtlos in Ihre Entwürfe integrieren, was die Klarheit erhöht und eine größere Anzahl von Zitaten ermöglicht. Sie können Ihre Forschung zugänglicher und eindrucksvoller machen, indem Sie Ihr Publikum visuell ansprechen. Mind the Graph unterstützt Ihre Arbeit mit überzeugenden Infografiken, die Ihre wissenschaftliche Kommunikation verbessern werden. Besuchen Sie unser Website für weitere Informationen.

In der Welt der Wörter und Gespräche ist die Diskursanalyse wie ein spezielles Vergrößerungsglas, das uns hilft zu verstehen, wie Sprache in verschiedenen Situationen funktioniert. Es geht nicht nur darum, was Wörter bedeuten, sondern auch darum, wie sie verwendet werden und warum.

Stellen Sie sich die Diskursanalyse als eine Möglichkeit vor, die verborgenen Muster und Bedeutungen in der Art und Weise, wie wir sprechen oder schreiben, zu erforschen. Die Diskursanalyse ist wie ein Schlüssel, der die Geheimnisse der Kommunikation entschlüsselt und uns zeigt, wie Sprache mit unserem täglichen Leben, unseren Kulturen und sogar mit der Machtdynamik zwischen Menschen zusammenhängt. In diesem Artikel erfahren Sie, was Diskursanalyse ist und welche Geschichten sich hinter den Wörtern verbergen, die wir jeden Tag benutzen.

Die Diskursanalyse ist eine interdisziplinäre Methode zur Untersuchung des Sprachgebrauchs in sozialen Kontexten. Anstatt sich nur auf die Struktur von Sätzen und Wörtern zu konzentrieren, untersucht die Diskursanalyse, wie Sprache durch soziale, kulturelle und Machtdynamiken geformt und gestaltet wird.

Sie befasst sich mit der gesprochenen und schriftlichen Kommunikation und zielt darauf ab, implizite Bedeutungen, gesellschaftliche Normen und Machtverhältnisse in der Sprache aufzudecken.

Im Kern betrachtet die Diskursanalyse die Sprache als soziales Konstrukt, das die Art und Weise, wie Menschen die Welt wahrnehmen und mit ihr interagieren, beeinflusst und widerspiegelt. Forscher in diesem Bereich untersuchen eine Vielzahl von Diskursen, von Alltagsgesprächen bis hin zu formalen Texten und Mediendarstellungen.

Die Diskursanalyse hat ihre Wurzeln in der Linguistik und der Philosophie, aber ihre formale Entwicklung gewann im 20. Jahrhundert an Dynamik. Frühe Sprachtheoretiker wie Ferdinand de Saussure untersuchten die strukturellen Aspekte der Sprache, während Philosophen wie Ludwig Wittgenstein die Bedeutung der Sprache für soziale Praktiken betonten.

Der Begriff "Diskursanalyse" wurde in den 1960er und 1970er Jahren von Wissenschaftlern wie Michel Foucault und Erving Goffman die das Feld beeinflussen. Foucault beispielsweise untersuchte, wie der Diskurs Wissen und Machtstrukturen in der Gesellschaft formt, während Goffman sich auf die Rolle der Sprache in persönlichen Interaktionen konzentrierte.